A Google DeepMind acaba de apresentar o Gemini Robotics-ER 1.6, a mais recente atualização do seu modelo de “Raciocínio Incorporado” (Embodied Reasoning), projetado para dar aos robôs aquela dose necessária de bom senso sobre o mundo físico. O novo modelo eleva consideravelmente a capacidade de uma máquina enxergar, compreender e interagir com o que está ao seu redor, indo muito além do simples cumprimento de ordens mecânicas para, de fato, raciocinar sobre suas tarefas.

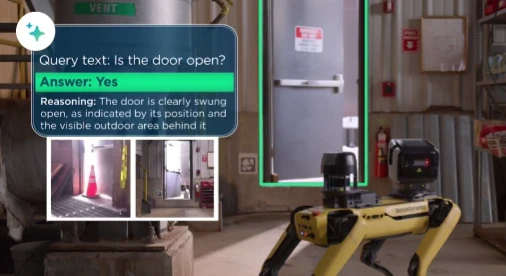

Um dos pilares do Gemini Robotics-ER 1.6 é o aprimoramento da compreensão visual e espacial, exemplificado pela sua nova habilidade de “apontar”. Peça para ele encontrar uma ferramenta específica em uma oficina caótica e o modelo agora consegue identificar, contar e cravar exatamente onde estão os itens corretos, ignorando o que não interessa. Não se trata apenas de localizar objetos; é a base para uma lógica espacial complexa, como traçar a trajetória perfeita para um agarre preciso ou entender comandos relacionais do tipo “mova a chave inglesa para a caixa de ferramentas”. O modelo consegue até processar restrições lógicas, como identificar quais objetos são pequenos o suficiente para caber em um determinado recipiente.

O modelo também ataca um velho calcanhar de Aquiles da robótica: saber quando o trabalho está, de fato, concluído. Graças ao raciocínio multi-ângulo (multi-view reasoning), o Gemini Robotics-ER 1.6 consegue fundir transmissões de vídeo ao vivo de várias câmeras simultaneamente — como uma visão aérea e outra acoplada ao pulso do robô — para construir uma imagem completa da cena. Isso evita que o robô entre em parafuso ou falhe em uma tarefa só porque um objeto ficou temporariamente escondido de um dos pontos de vista.

Por que isso muda o jogo?

Esta atualização é mais do que um simples ajuste de performance; trata-se de construir as fundações da autonomia real. A capacidade de ler manômetros analógicos, cruzar dados de múltiplas câmeras e entender relações espaciais complexas é o que separa um braço mecânico de linha de montagem de um robô útil em campo. De acordo com o anúncio oficial da DeepMind, este é o seu modelo robótico mais seguro até hoje.

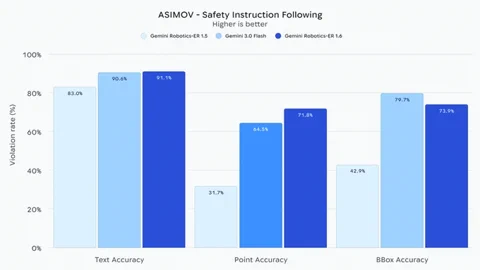

Talvez o ponto mais crítico seja a “capacidade substancialmente aprimorada” do Gemini Robotics-ER 1.6 em respeitar restrições de segurança física. Ele compreende instruções como evitar o contato com líquidos ou não levantar objetos acima de 20 kg. Comparado ao modelo base Gemini 3.0 Flash, ele é 10% superior na percepção de riscos de acidentes humanos em vídeos. Esse foco em segurança e raciocínio prático é um passo crucial para que robôs possam operar de forma confiável em ambientes humanos imprevisíveis. O modelo já está disponível para desenvolvedores através da API do Gemini e no Google AI Studio.