Treinar um robô é, convenhamos, um trabalho de Sísifo: um processo ingrato, um moedor de carne de resets manuais e supervisão ininterrupta. Para cada movimento bem-sucedido que uma máquina aprende, houve um humano atrás dela resetando o cenário dezenas de vezes após cada falha. Um novo framework chamado RoboClaw quer dar um basta nesse pesadelo, ensinando aos robôs a única habilidade que realmente lhes faltava: a capacidade de arrumar a própria bagunça.

Desenvolvido por pesquisadores da AgiBot, da Universidade Nacional de Singapura e da Universidade Jiao Tong de Xangai, o RoboClaw introduz um conceito tão simples quanto brilhante: os Pares de Ação Entrelaçados (EAP). A lógica é direta: para cada habilidade “de ida” que o robô domina — como encaixar um batom em um organizador —, ele aprende simultaneamente a manobra inversa, o “desfazer” — retirar o batom de lá. Esse binômio cria um loop de autorreset, permitindo que o robô pratique, erre, limpe o palco e tente de novo, tudo de forma autônoma. Sem precisar de uma “babá” humana por perto.

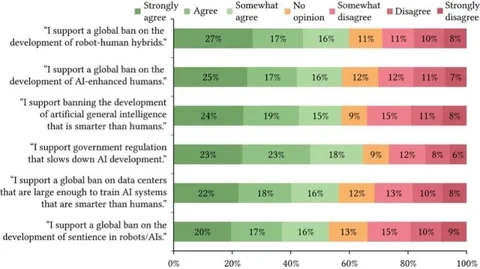

Os números são, para dizer o mínimo, impressionantes. Os pesquisadores relatam uma redução de 8 vezes na intervenção humana durante o treinamento e uma economia de 2,16 vezes no tempo total de dedicação humana por conjunto de dados. Além disso, o sistema apresentou uma taxa de sucesso 25% maior em tarefas complexas e de múltiplas etapas quando comparado aos modelos de referência. Em testes práticos, o robô foi colocado para organizar uma penteadeira, aprendendo sozinho a manipular diversos itens e — o mais importante — a se recuperar de seus próprios erros pelo caminho.

Por que isso é um divisor de águas?

O verdadeiro “pulo do gato” aqui não é apenas o loop de autorreset. É o fato de que o mesmo agente que treina o robô é o que o opera no mundo real. A maioria dos sistemas robóticos atuais utiliza fluxos totalmente desconectados para coleta de dados, treinamento de modelo e execução final. O RoboClaw unifica essa tríade sob um único controlador movido por Modelos de Visão e Linguagem (VLM).

Na prática, isso significa que, quando o robô falha em uma tarefa real, essa falha não é apenas um erro que exige um técnico; ela se torna um novo dado de treinamento injetado diretamente no sistema. O robô aprende com seus próprios tropeços em campo, criando um ecossistema de ciclo fechado que evolui continuamente. É o início de uma transição fundamental: saímos da automação rígida e pré-programada para sistemas verdadeiramente agênticos, capazes de aprender e se adaptar em tempo real no “mundo selvagem”.