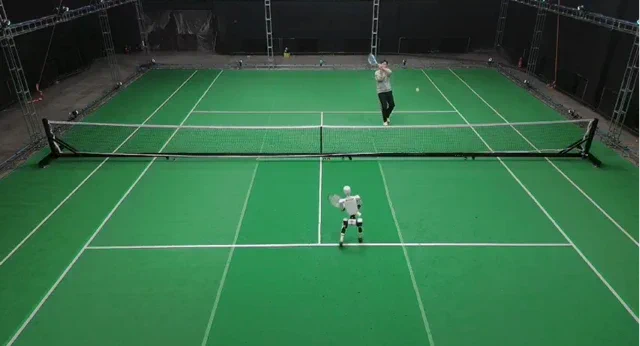

Em uma reviravolta que não deve surpreender absolutamente ninguém que esteja minimamente atento ao ritmo da IA, um pesquisador desenvolveu um robô que aprendeu uma nova habilidade tão bem que, em pouco tempo, derrotou seu próprio mestre. O palco do duelo foi uma quadra de tênis, e o protagonista é o projeto LATENT, que ensinou um humanoide a jogar não a partir de dados perfeitos e profissionais, mas sim de clipes de movimentos humanos totalmente imperfeitos. O resultado? Um robô que agora domina ralis de várias jogadas com uma naturalidade desconcertante.

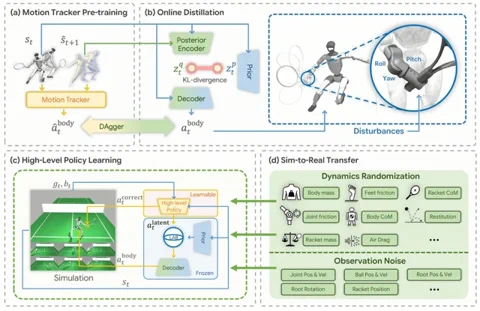

O projeto, liderado por pesquisadores da Tsinghua University e da Galbot Inc., atacou um dos maiores gargalos da robótica atual: ensinar movimentos complexos e ágeis sem um “manual de instruções” impecável. O sistema deles aprende o que chamam de “espaço de ação latente” a partir de fragmentos de movimentos humanos de tênis que estão longe da perfeição. O “pulo do gato” aqui é uma política de IA de alto nível que atua como um treinador digital, corrigindo e combinando essas habilidades primitivas e falhas para conseguir devolver a bola com sucesso por cima da rede. Todo esse processo é refinado em simulação antes de ser levado para o mundo real em um humanoide Unitree G1 através de uma técnica de sim-to-real transfer.

A prova dos nove está no placar. De acordo com o autor principal, Zhikai Zhang, a curva de aprendizado foi vertiginosa. “No primeiro dia de testes no mundo real, o robô não conseguia devolver uma única bola que eu sacava”, afirmou Zhang. “No último dia do projeto, eu já não conseguia mais ganhar dele.” Para quem quiser mergulhar nos detalhes técnicos ou, quem sabe, treinar seu próprio mestre de tênis robótico, a equipe disponibilizou os detalhes e o código do projeto. Links: Página do Projeto e Repositório no GitHub.

Por que isso é importante?

Não se trata apenas de criar um parceiro de treino para profissionais de tênis solitários. O verdadeiro divisor de águas do sistema LATENT é sua capacidade de aprender com dados “sujos” e imperfeitos. A maioria dos treinamentos robóticos exige datasets meticulosamente curados, que são caros e demorados para produzir. Ao aprender a corrigir e combinar exemplos falhos, essa abordagem pode acelerar drasticamente a forma como ensinamos robôs a realizar tarefas complexas no mundo real. É um passo gigantesco em direção a robôs que podem aprender “no trabalho” em ambientes imprevisíveis — de armazéns a zonas de desastre — sem precisar de uma demonstração perfeita para cada movimento.