A indústria da robótica guarda um segredo sujo: ensinar um robô a fazer qualquer coisa minimamente útil é um processo agoniante, lento e estupidamente caro. Durante anos, a sabedoria convencional ditou que a inteligência deveria ser obtida na base da força bruta com os modelos Vision-Language-Action (VLAs), que exigem dezenas de milhares de horas de humanos operando robôs como marionetes em cada tarefa imaginável. É um gargalo de dados de proporções épicas.

Agora, a empresa de robótica 1X propõe uma solução que beira a heresia. A nova abordagem para o seu humanoide NEO é deceptivamente simples: parar com as lições meticulosas e deixar que o robô aprenda apenas observando a vasta, caótica e infinitamente instrutiva biblioteca do comportamento humano que chamamos de internet. Isso não é apenas um upgrade; é uma mudança fundamental na forma como uma máquina adquire habilidades.

A fera faminta por dados do passado

Para entender o salto que a 1X está dando, é preciso compreender o status quo. A maioria dos modelos de fundação modernos para robótica, do Helix da Figure ao GR00T da NVIDIA, são VLAs. Esses modelos são potentes, mas têm uma fome insaciável por dados de demonstração de alta qualidade e específicos para robôs. Na prática, isso significa pagar pessoas para teleoperar robôs por milhares de horas para coletar exemplos de, digamos, pegar uma xícara ou dobrar uma toalha.

Essa abordagem é o maior impedimento para a criação de robôs de uso geral. É caro, não escala bem e os modelos resultantes podem ser frágeis, falhando ao encontrar um objeto ou ambiente que nunca viram antes. É como tentar ensinar uma criança a cozinhar permitindo que ela observe apenas a sua cozinha, em vez de deixá-la maratonar todos os programas de culinária já produzidos.

Sonhe um pouco com… as tarefas domésticas

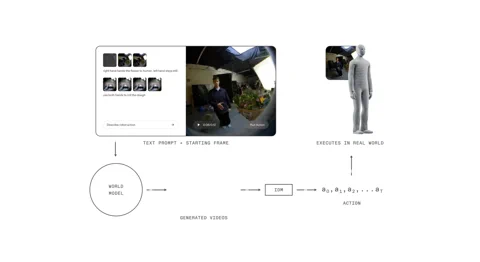

O 1X World Model (1XWM) joga esse manual de instruções no lixo. Em vez de mapear diretamente a linguagem para ações, ele utiliza a geração de vídeo condicionada por texto para descobrir o que fazer. Trata-se de um cérebro dividido em duas partes que, efetivamente, permite que o robô imagine o futuro antes de agir.

Primeiro, temos o World Model (WM), um modelo de vídeo generativo de 14 bilhões de parâmetros que atua como a imaginação do sistema. Você dá ao NEO um comando de texto — “coloque esta laranja na lancheira” — e o WM, analisando a cena atual, projeta um vídeo curto e plausível da tarefa sendo concluída.

Depois, entra em cena o Inverse Dynamics Model (IDM), o pragmático da máquina, que analisa esse “sonho”. Ele traduz os pixels gerados em uma sequência concreta de comandos motores, preenchendo a lacuna entre o quê visual e o como físico. Esse processo é fundamentado por uma estratégia de treinamento em várias etapas: o modelo começa com vídeos em escala da web, passa por um treinamento intermediário com 900 horas de vídeos humanos egocêntricos (primeira pessoa) e, finalmente, é ajustado (fine-tuned) com apenas 70 horas de dados específicos do NEO para se adaptar ao seu próprio corpo.

Um truque astuto no pipeline de treinamento é o “upsampling de legendas”. Como muitos conjuntos de dados de vídeo possuem descrições curtas, a 1X usa um VLM para gerar legendas mais ricas e detalhadas. Isso oferece um condicionamento mais claro e melhora a capacidade do modelo de seguir instruções complexas — uma técnica que já mostrou benefícios semelhantes em modelos de imagem como o DALL-E 3 da OpenAI.

A vantagem de ter corpo de gente

Toda essa abordagem focada em vídeo depende de uma peça de hardware crítica e, talvez, óbvia: o robô tem formato de ser humano. O 1XWM, treinado em incontáveis horas de humanos interagindo com o mundo, desenvolveu uma compreensão profunda e implícita de leis físicas — gravidade, momento, fricção, utilidade de objetos — que são transferidas diretamente porque o corpo do NEO se move de forma fundamentalmente humana.

Como a 1X define, o hardware é um “cidadão de primeira classe na pilha de IA”. As semelhanças cinemáticas e dinâmicas entre o NEO e um humano significam que os aprendizados prévios do modelo permanecem válidos. O que o modelo consegue visualizar, o NEO consegue, na maioria das vezes, executar de fato. Essa integração estreita entre hardware e software fecha o abismo, muitas vezes traiçoeiro, entre a simulação e a realidade.

Da teoria à realidade (com alguns tropeços)

Os resultados são impressionantes. O 1XWM permite que o NEO generalize para tarefas e objetos para os quais ele não possui nenhum dado de treinamento direto. O vídeo promocional mostra o robô passando uma camisa a ferro, regando uma planta e até levantando a tampa de um vaso sanitário — uma tarefa para a qual ele não tinha exemplos prévios. Isso sugere que o conhecimento para coordenação bimanual e interação complexa com objetos está sendo transferido com sucesso dos dados de vídeo humano.

Mas não se trata de mágica. O sistema tem suas limitações. As projeções geradas podem ser “otimistas demais” quanto ao sucesso, e o pré-treinamento monocular pode levar a uma percepção 3D fraca, fazendo com que o robô real erre o alvo mesmo quando o vídeo gerado parece perfeito. As taxas de sucesso em tarefas de alta destreza, como servir cereais ou desenhar um rosto sorridente, continuam sendo um desafio.

No entanto, a 1X encontrou uma forma promissora de turbinar o desempenho: o poder computacional no momento da execução (test-time compute). Para uma tarefa de “puxar um lenço”, a taxa de sucesso saltou de 30% com uma única geração de vídeo para 45% quando o sistema teve permissão para gerar oito futuros possíveis e selecionar o melhor. Embora essa seleção ainda seja manual, ela aponta para um futuro onde um avaliador VLM poderá automatizar o processo, aumentando significativamente a confiabilidade.

O volante do autoaprendizado

O 1XWM representa mais do que uma atualização incremental; é uma potencial mudança de paradigma que pode escancarar o gargalo de dados. Ele cria um efeito de “flywheel” para o autoaperfeiçoamento. Ao ser capaz de tentar um amplo conjunto de tarefas com uma taxa de sucesso não nula, o NEO pode agora gerar seus próprios dados. Cada ação, seja um sucesso ou uma falha, torna-se um novo exemplo de treinamento que pode ser realimentado no modelo para refinar sua política. O robô começa a ensinar a si mesmo.

Claro, ainda restam grandes obstáculos. O WM leva atualmente 11 segundos para gerar um plano de 5 segundos, com mais um segundo para o IDM extrair as ações. Essa latência é uma eternidade em um ambiente dinâmico do mundo real e inviabiliza tarefas reativas ou manipulações delicadas que exigem contato constante.

Ainda assim, ao enfrentar o problema dos dados de frente, a 1X pode ter acabado de abrir a porta para um futuro onde os robôs não aprendem com as nossas instruções tediosas, mas sim com a nossa experiência coletiva gravada. Esse futuro está acelerando, um vídeo da internet por vez.