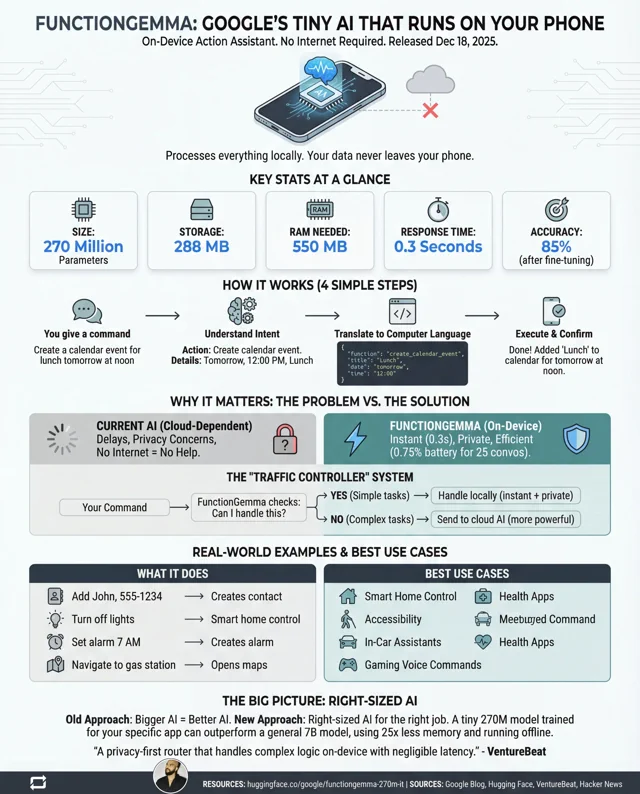

No dia 18 de dezembro de 2025, a Google lançou discretamente o FunctionGemma, um modelo de IA minúsculo com apenas 270 milhões de parâmetros, desenhado para correr inteiramente dentro dos dispositivos. O comunicado de imprensa focou-se nos smartphones — definir lembretes, ligar a lanterna, as tarefas habituais dos assistentes digitais. Mas, escondido entre as especificações técnicas, está algo muito mais disruptivo: a planta para tornar os robôs drasticamente mais baratos.

Aqui está o segredo sujo dos robôs “inteligentes” de hoje: a maioria não é inteligente de todo. São apenas terminais. A inteligência reside num centro de dados a milhares de quilómetros de distância, ligada por uma ligação à internet que acrescenta latência, custa dinheiro e falha no momento em que entramos numa zona sem rede. Sempre que o seu robô de armazém precisa de tomar uma decisão, ele está a “ligar para casa” como um adolescente nervoso a pedir autorização.

O FunctionGemma muda completamente as contas.

Os Números que Realmente Contam

Vamos ignorar o marketing e olhar para o que realmente importa para a robótica:

- 288 MB de armazenamento – Cabe nos microcontroladores mais baratos do mercado.

- 550 MB de RAM – Um Raspberry Pi 4 tem 8 GB de sobra para isto.

- 0,3 segundos de tempo de resposta – Processamento local, sem idas e voltas à rede.

- 58% de precisão base → 85% após fine-tuning – Treinável para tarefas específicas.

Este último ponto é crucial. O FunctionGemma não foi feito para ser um chatbot de cultura geral. Foi desenhado para ser afinado (fine-tuned) para tarefas estreitas e específicas — exatamente o que os robôs fazem. Um robô de armazém não precisa de discutir existencialismo. Precisa de entender “apanha a caixa A, move para a prateleira B” e executar isso na perfeição, milhares de vezes por dia.

Por que os Robôs Dependentes da Nuvem são um Beco Sem Saída

O paradigma atual dos robôs “inteligentes” está fundamentalmente quebrado. Pense no que acontece quando o seu robô precisa de tomar uma decisão:

- Os dados dos sensores são captados.

- Os dados são comprimidos e enviados para a nuvem.

- O servidor na nuvem processa o pedido.

- A resposta é enviada de volta.

- O robô age.

São cinco etapas com múltiplos pontos de falha. Congestionamento na rede? O robô congela. Servidor sobrecarregado? O robô espera. Falha na internet? O robô torna-se um pisa-papéis caríssimo. E você está a pagar por cada milissegundo de processamento e cada megabyte de transferência de dados.

Para um único aspirador doméstico, isto pode ser tolerável. Para uma frota de 500 robôs de armazém a funcionar 24/7? As faturas da nuvem sozinhas poderiam levá-lo à falência, e a latência torna a coordenação em tempo real quase impossível.

A Revolução da Edge Computing Chega à Robótica

O FunctionGemma representa uma mudança filosófica: em vez de perguntar “como tornamos os robôs inteligentes o suficiente para precisarem da nuvem”, a Google está a perguntar “como tornamos a nuvem pequena o suficiente para caber num robô”.

Isto não é inédito. A indústria automóvel percebeu isto há anos — a travagem de emergência do seu carro não liga para a Google antes de decidir parar. A decisão acontece localmente, em milissegundos, porque a latência mata (literalmente). Mas, até agora, os modelos de IA capazes de compreender comandos de linguagem natural e traduzi-los em ações eram demasiado massivos para serem implementados na “ponta” (edge).

Como será a Robótica Barata

Imagine um robô assistente doméstico de 200 € com:

- Compreensão total de linguagem natural para comandos comuns.

- Sem taxas de subscrição mensal.

- Funciona perfeitamente durante falhas de internet.

- Os seus dados de voz nunca saem do dispositivo.

- Resposta instantânea aos comandos.

Ou imagine robôs agrícolas que podem operar em campos com zero cobertura de rede móvel. Drones de resposta a desastres que não precisam de um Starlink para funcionar. Companheiros de cuidados a idosos que não exigem uma subscrição na nuvem para lembrar alguém de tomar a medicação.

A poupança de custos acumula-se em todos os níveis. Hardware de computação mais barato significa robôs mais baratos. Sem dependência da nuvem significa sem taxas recorrentes. Processamento local significa requisitos de rede mais simples. Privacidade por design significa aprovação regulatória mais fácil.

A Arquitetura de “Controlador de Tráfego”

A Google não é ingénua ao ponto de afirmar que o FunctionGemma pode substituir totalmente os grandes modelos de linguagem (LLMs). A arquitetura proposta é mais astuta: usar o FunctionGemma como um “controlador de tráfego” local que resolve 90% dos comandos simples imediatamente, e apenas encaminha consultas complexas para a nuvem quando estritamente necessário.

Para um robô, isto seria algo como:

- Resolvido localmente: “Move-te para a frente”, “Para”, “Apanha o objeto vermelho”, “Volta para a base de carregamento”.

- Encaminhado para a nuvem: “Analisa este objeto estranho e diz-me o que é”, “Planeia uma rota otimizada através deste novo ambiente”.

Esta abordagem híbrida oferece a velocidade e a fiabilidade da computação local para operações rotineiras, preservando o acesso à inteligência de escala global para casos excecionais.

O Fator Fine-Tuning

Talvez o aspeto mais importante para a robótica seja a capacidade de treino do FunctionGemma. A precisão base de 58% soa terrível — e é, para um assistente generalista. Mas, quando afinado num vocabulário específico de comandos e ações robóticas, esse valor salta para os 85%.

Agora imagine o que acontece quando uma empresa de robótica o otimiza especificamente para o seu caso de uso:

- Robô de picking em armazém: 50 comandos centrais, vocabulário otimizado, precisão potencialmente acima dos 95%.

- Drone de entrega: comandos de navegação, protocolos de segurança, respostas a condições meteorológicas.

- Braço industrial: instruções de movimento precisas, verificações de controlo de qualidade.

Cada tipo de robô recebe um “cérebro” de IA feito à medida, com o tamanho perfeito para as suas necessidades e treinado exatamente no vocabulário que irá encontrar. É o oposto da abordagem “um modelo gigante para todos” — é modular, eficiente e implementável.

Implicações para os Fabricantes de Robôs

Para as empresas que constroem robôs, o FunctionGemma representa um ponto de inflexão estratégico:

Mudança na estrutura de custos: A lista de materiais (BOM) para um robô “inteligente” pode cair centenas de euros quando não se precisa de hardware de rede caro e redundância de conectividade na nuvem.

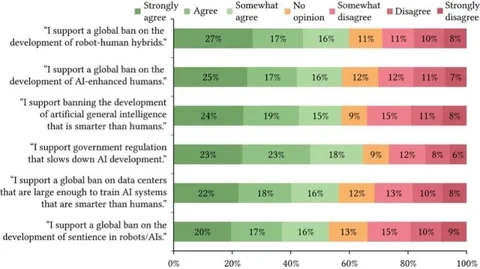

Morte do modelo de subscrição: O “Robô como Serviço” (RaaS) depende da dependência da nuvem para prender os clientes a pagamentos recorrentes. A IA local quebra esse modelo — e os clientes vão notar.

Fiabilidade alcançável: Um robô que funciona de forma autónoma significa tempo de atividade garantido sem necessidade de infraestruturas de rede heroicas.

Privacidade como funcionalidade: Dados que nunca saem do dispositivo não podem ser roubados, filtrados ou intimados judicialmente.

O que Falta

Não vamos exagerar. O FunctionGemma tem limitações reais:

- Sem raciocínio de múltiplas etapas: “Apanha a caixa, verifica a etiqueta e coloca-a no contentor certo” está atualmente além das suas capacidades.

- Dificuldade com comandos indiretos: “A sala está muito clara” não ativará um ajuste de iluminação automaticamente.

- Taxa de erro de 15%: Aceitável para muitas aplicações, perigoso para outras.

Mas estes são problemas de software com soluções conhecidas. O raciocínio de múltiplas etapas é para o que serve o chain-of-thought prompting. Os comandos indiretos podem ser resolvidos com fine-tuning em paráfrases. As taxas de erro vão cair com conjuntos de dados de treino maiores e novas iterações do modelo.

As restrições de hardware — esse é o problema difícil. E a Google acabou de provar que 270 milhões de parâmetros são suficientes para chamadas de funções práticas. Esse é o verdadeiro avanço.

A Visão Geral

O FunctionGemma não vai criar sozinho a revolução robótica. Mas é a prova de conceito de que a indústria de IA precisava desesperadamente: não é necessário um modelo de um bilião de parâmetros para tornar as máquinas úteis. É necessário o modelo do tamanho certo para o trabalho certo.

As implicações estendem-se além da robótica para o IoT, wearables, dispositivos médicos e qualquer outra coisa que precise de tomar decisões sem “ligar para casa”. Mas, especificamente para a robótica, este parece ser o momento pelo qual a indústria esperava — o momento em que “robô inteligente” deixa de exigir “robô caro”.

O futuro da robótica acessível não está na nuvem. Está em 288 megabytes de pesos cuidadosamente treinados, a correr localmente, a responder instantaneamente e a funcionar em qualquer lugar. A Google deu-nos um vislumbre desse futuro. Agora cabe aos fabricantes de robôs construí-lo.