Google DeepMind właśnie wyłożyło karty na stół, prezentując Gemini Robotics-ER 1.6. To najnowsza odsłona modelu opartego na „rozumowaniu ucieleśnionym” (Embodied Reasoning), która ma wstrzyknąć robotom solidną dawkę zdrowego rozsądku w interakcji ze światem fizycznym. Nowy model to potężny skok naprzód w kwestii tego, jak maszyny widzą, rozumieją i reagują na otoczenie – zamiast bezmyślnego odtwarzania zaprogramowanych ruchów, roboty zaczynają realnie analizować sens swoich zadań.

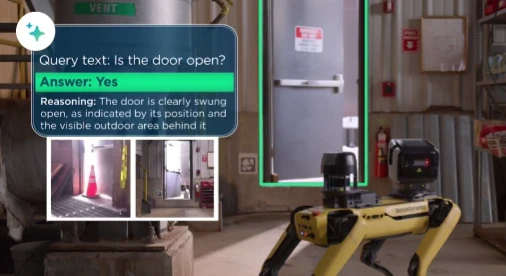

Kluczowym elementem aktualizacji Gemini Robotics-ER 1.6 jest radykalna poprawa percepcji wizualno-przestrzennej, którą najlepiej obrazuje nowa umiejętność „wskazywania”. Poproście robota o znalezienie konkretnego narzędzia w zagraconym warsztacie, a model bezbłędnie zidentyfikuje, policzy i namierzy odpowiedni przedmiot, ignorując przy tym cały otaczający go chaos. To nie tylko kwestia „widzenia” – to fundament pod złożoną logikę przestrzenną. Dzięki niej robot potrafi wyznaczyć optymalną trajektorię chwytu czy zrozumieć polecenia relacyjne, takie jak „przełóż klucz do skrzynki narzędziowej”. Model potrafi nawet analizować ograniczenia fizyczne, samodzielnie oceniając, które przedmioty są na tyle małe, by zmieścić się w konkretnym pojemniku.

Model bierze się również za bary z odwieczną zmorą robotyki: świadomością, kiedy zadanie zostało faktycznie ukończone. Dzięki zaawansowanemu rozumowaniu wieloperspektywicznemu (multi-view reasoning), Gemini Robotics-ER 1.6 potrafi łączyć strumienie wideo z wielu kamer jednocześnie – na przykład z kamery zawieszonej pod sufitem oraz tej zamontowanej na nadgarstku robota. Pozwala to na zbudowanie pełnego obrazu sytuacji i zapobiega zapętleniu się maszyny lub porażce tylko dlatego, że jakiś obiekt został chwilowo zasłonięty w jednym z kadrów.

Dlaczego to przełom?

Ta aktualizacja to coś więcej niż tylko kosmetyczne poprawki w tabelkach z wynikami; to budowanie fundamentów pod prawdziwą autonomię. Umiejętność odczytywania analogowych wskaźników, fuzja danych z wielu kamer i rozumienie skomplikowanych zależności przestrzennych to granica oddzielająca sztywne ramię fabryczne od użytecznego robota polowego. Według oficjalnego komunikatu DeepMind, jest to ich najbezpieczniejszy model robotyczny do tej pory.

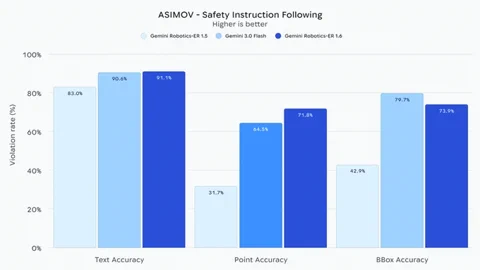

Co być może najważniejsze, Gemini Robotics-ER 1.6 wykazuje „znacząco lepszą zdolność” do przestrzegania fizycznych ograniczeń bezpieczeństwa. Maszyna rozumie instrukcje takie jak unikanie kontaktu z cieczami czy zakaz podnoszenia przedmiotów cięższych niż 20 kg. W porównaniu do bazowego modelu Gemini 3.0 Flash, nowa wersja o 10% skuteczniej rozpoznaje wideo przedstawiające ryzyko urazów u ludzi. Postawienie na bezpieczeństwo i logiczne wnioskowanie w czasie rzeczywistym to kluczowy krok w stronę robotów, które będą mogły bezpiecznie pracować w nieprzewidywalnym, ludzkim środowisku. Model jest już dostępny dla deweloperów za pośrednictwem Gemini API oraz Google AI Studio.