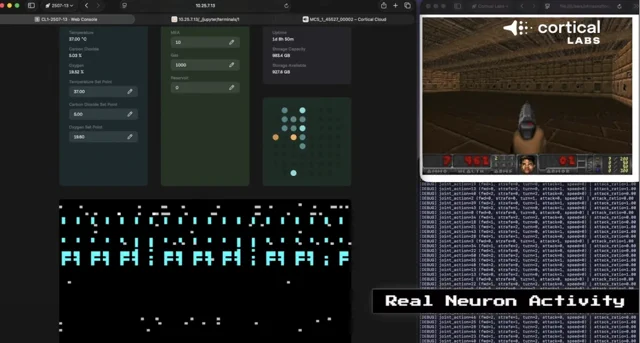

Kiedy wydawało się, że hype na sztuczną inteligencję osiągnął już szczyt absurdu, pewna firma z Australii postanowiła wyrzucić procesory graficzne do kosza i podłączyć AI bezpośrednio do żywego, biologicznego mózgu. No, prawie. Cortical Labs, biotechnologiczny startup, który wcześniej zasłynął nauczeniem 800 000 ludzkich neuronów gry w klasycznego Ponga, przeszedł na wyższy poziom wtajemniczenia. Po udanym treningu nowej partii 200 000 neuronów, które musiały przedzierać się przez pełne demonów korytarze DOOM-a, naukowcy podpięli swój „DishBrain” do modelu językowego (LLM).

Tak, dobrze czytacie. Żywe ludzkie komórki mózgowe, generujące impulsy elektryczne na krzemowym chipie, decydują teraz o tym, jakie słowa wypowiada AI. To nie jest kolejny nudny krok w rozwoju uczenia maszynowego; to fascynujący, a zarazem nieco ciarki wywołujący skok w świat „wetware” i komputerów biologicznych. Szczerze mówiąc, przy tym projekcie przeciętny chatbot wygląda na równie zaawansowany co kalkulator kieszonkowy.

Od pikselowych paletek do piekielnych czeluści

Aby zrozumieć, jak doszliśmy do momentu, w którym komórki mózgowe współtworzą teksty, musimy cofnąć się do największych hitów Cortical Labs. W 2022 roku zespół z Melbourne trafił na czołówki mediów dzięki eksperymentowi „DishBrain”. Wyhodowali neurony na matrycy mikroelektrod, która potrafiła zarówno stymulować komórki, jak i odczytywać ich aktywność. Wysyłając sygnały elektryczne informujące o pozycji piłeczki w Pongu, naukowcy sprawili, że neurony nauczyły się sterować paletką w zaledwie pięć minut. Był to oszałamiający dowód na istnienie syntetycznej inteligencji biologicznej.

Ale Pong to igraszka. W świecie technologii od lat obowiązuje niepisana zasada testowania sprzętu: „A czy pójdzie na tym DOOM?”. Cortical Labs nie mogło przejść obok tego obojętnie. Przeskok z prostego, dwuwymiarowego świata paletek do trójwymiarowego środowiska kultowej strzelanki był gigantyczny – wymagał nawigacji przestrzennej, wykrywania zagrożeń i podejmowania szybkich decyzji. Mimo to, neurony dały radę. Obraz z gry tłumaczono na wzorce stymulacji elektrycznej, a odpowiedzi neuronów dekodowano na ruchy postaci i strzały. Choć ich styl gry przypominał raczej zdezorientowanego nowicjusza niż profesjonalnego e-sportowca, eksperyment udowodnił, że system potrafi radzić sobie z dynamicznymi i złożonymi zadaniami.

Biologiczny duch w maszynie LLM

Po podbiciu klasyków gamingu, kolejnym logicznym krokiem było najwyraźniej nadanie neuronom głosu. Najnowszy eksperyment, nagłośniony m.in. przez ewangelistę technologii Roberta Scoble’a, pokazuje interfejs łączący komórki mózgowe z modelem językowym. Zamiast poruszać paletką czy kosmicznym komandosem, impulsy elektryczne generowane przez neurony służą teraz do wybierania poszczególnych tokenów – liter lub słów – które tworzy AI.

Krótki film zza kulis pokazuje ten proces w akcji: na siatce widać stymulowane kanały i sygnały zwrotne od neuronów, które wspólnie „decydują” o kolejnym fragmencie tekstu. To surowy, niefiltrowany wgląd w materię biologiczną wykonującą zadanie kognitywne, które do tej pory było wyłączną domeną skomplikowanych algorytmów działających na prądożernym krzemie.

„Pokazaliśmy, że potrafimy wchodzić w interakcję z żywymi neuronami w sposób, który zmusza je do modyfikacji ich aktywności, co prowadzi do czegoś, co przypomina inteligencję” – stwierdził dr Brett Kagan, dyrektor naukowy Cortical Labs, odnosząc się do wcześniejszych prac zespołu.

Ten nowy kierunek wynosi wspomnianą interakcję na zupełnie inny poziom. Jedną rzeczą jest reagowanie na odbijającą się piłeczkę, a zupełnie inną – branie udziału w procesie tworzenia języka.

Po co nam mózgi w komputerach?

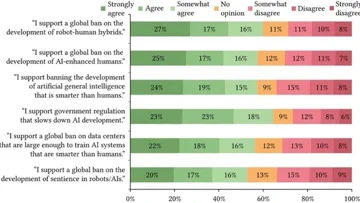

W tym momencie możecie zapytać: po co zadawać sobie tyle trudu z utrzymywaniem 200 000 neuronów przy życiu na szalce, skoro high-endowe GPU radzi sobie z LLM-ami bez mrugnięcia okiem? Odpowiedź tkwi w wydajności i fizycznych limitach krzemu. Ludzki mózg wykonuje niewiarygodną liczbę operacji, zużywając przy tym około 20 watów energii – tyle, co słaba żarówka. Superkomputer próbujący symulować taką samą aktywność potrzebowałby jej miliony razy więcej.

Cortical Labs i inni pionierzy w tej dziedzinie wierzą, że tę niesamowitą energooszczędność można okiełznać. Systemy biologiczne doskonale radzą sobie z przetwarzaniem równoległym i adaptacyjnym uczeniem się w sposób, którego tradycyjne, binarne i deterministyczne komputery nie potrafią idealnie skopiować. Łącząc żywe neurony z krzemem, tworzą hybrydową architekturę obliczeniową, która w przyszłości może zasilać systemy uczące się szybciej i zużywające ułamek energii dzisiejszych centrów danych.

Nie chodzi tu tylko o zbudowanie lepszego chatbota. Zespół Cortical Labs, kierowany przez CEO dr. Hon Weng Chonga, widzi przyszłość, w której ta technologia zrewolucjonizuje robotykę, medycynę personalizowaną i proces odkrywania leków. Wyobraźcie sobie robota, który nie tylko wykonuje zaprogramowane komendy, ale uczy się i adaptuje do nowego otoczenia z płynną inteligencją systemu biologicznego. Albo testowanie leków na padaczkę bezpośrednio na chipie z neuronami konkretnego pacjenta.

Droga przed nimi jeszcze daleka. Systemy biologiczne są złożone i nieprzewidywalne, co stanowi całkowite przeciwieństwo stabilności krzemu. Jednak, jak pokazało Cortical Labs, skupisko komórek w naczyniu laboratoryjnym przeszło już drogę od gier wideo do mówienia. Wizja tych samych neuronów sterujących w przyszłości robotem nie jest już tylko domeną science fiction – to kolejny punkt w ich planie rozwoju. I jest to myśl, która jest jednocześnie przerażająca i absolutnie fascynująca.