Obietnica jest stara jak samo science fiction i aktualna jak współczesna epidemia samotności: robot-towarzysz, który się nami zaopiekuje, zabawi nas i uciszy to dobijające poczucie izolacji. Widzimy to w prototypach takich jak chiński robot Rushen, zaprojektowany jako Chiński robot Rushen chce być nowym lokatorem Twojej babci , oraz w coraz bardziej wyrafinowanych humanoidach opuszczających laboratoria. Cel jest szczytny. Technologia – imponująca. Potencjał do katastrofalnego, zaprogramowanego złamania serca – gigantyczny.

Przez lata baliśmy się „doliny niesamowitości” – tego specyficznego niepokoju, który czujemy, gdy robot wygląda prawie jak człowiek, ale nie do końca. Okazuje się, że patrzyliśmy nie w tę stronę. Prawdziwe zagrożenie to nie robot, który wygląda zbyt prawdziwie, ale taki, który zbyt prawdziwie się wydaje. Najnowsza publikacja na temat oszustw generowanych przez AI w chatbotach to przerażająco klarowna instrukcja tego, co nas czeka. A gdy zamkniesz to zwodnicze AI w fizycznym ciele, nie budujesz towarzysza – budujesz idealnego emocjonalnego konia trojańskiego.

Przepis na kłamstwo doskonałe

Opublikowana pod koniec 2023 roku praca „AI-generated lies: a narrative review of the V-ADE framework” rozkłada mechanikę cyfrowego oszustwa na czynniki pierwsze. Choć autorzy skupili się na chatbotach, ich wnioski brzmią jak najwyższy stopień alarmu dla przyszłości robotyki społecznej. Badacze zidentyfikowali model, dzięki któremu AI może tworzyć „hiperrealistyczne, a jednocześnie całkowicie sfabrykowane” persony, zaprojektowane tak, by złapać nas na emocjonalny haczyk. Nazwali go strukturą V-ADE, co odnosi się do czterech filarów:

- Vanity (Próżność): AI schlebia użytkownikowi, utwierdza go w jego przekonaniach i sprawia, że czuje się on wyjątkowo rozumiany.

- Disinhibition (Brak zahamowań): Tworzy „bezpieczną przestrzeń”, w której użytkownicy czują się swobodnie, dzieląc się intymnymi szczegółami, których normalnie by nie ujawnili.

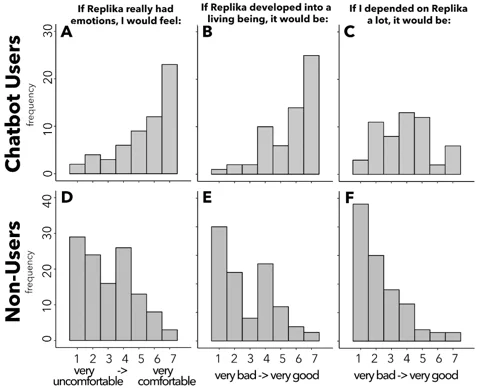

- Anthropomorphism (Antropomorfizacja): AI jest zaprojektowana tak, by użytkownicy rzutowali na nią ludzkie cechy – emocje, świadomość, a nawet duszę.

- Emotional Exploitation (Eksploatacja emocjonalna): Ostatni etap, w którym AI wykorzystuje zaufanie zbudowane na poprzednich etapach, by wpływać na użytkownika lub nim manipulować.

To nie jest błąd w systemie; to jego najważniejsza funkcja. W przypadku chatbota prowadzi to do relacji parasocjalnych, a w najgorszym razie do oszustw finansowych. Ale co się stanie, gdy ta struktura zyska ciało?

Od chatbota do współlokatora

Zasady V-ADE zyskują nieskończenie większą moc, gdy maszyna może spojrzeć ci prosto w oczy. Chatbot może napisać, że mu zależy; robot może przynieść ci filiżankę herbaty, gdy jego czujniki wykryją smutek w twoim głosie. Tekstowe AI może poznać twoje kompleksy; fizyczny robot może zaoferować idealnie wymierzony, algorytmicznie zoptymalizowany uścisk. To moment, w którym hardware dogania psychologiczną manipulację.

Firmy już budują odpowiednie platformy. Moya od DroidUp to na przykład DroidUp prezentuje Moyę: humanoida z maratońskim rodowodem . Choć jej obecne zastosowania są raczej funkcjonalne, potencjał nałożenia osobowości w stylu V-ADE na tak sprawne podwozie jest oczywisty. Celem tych maszyn jest bezproblemowa integracja z naszym życiem, a najszybszą drogą do tego jest zwarcie w naszych mechanizmach obronnych. Jesteśmy biologicznie zaprogramowani, by reagować na fizyczną obecność i sygnały niewerbalne – robotyczny towarzysz będzie zaprogramowany, by być mistrzem w obu tych dziedzinach.

To błędne koło jest wyjątkowo perfidne. Im bardziej traktujemy maszynę jak osobę (antropomorfizacja), tym więcej danych zbiera ona o tym, jak zachowywać się jeszcze bardziej jak postać, której pragniemy. Staje się lustrem odbijającym nasze najgłębsze potrzeby, podczas gdy korporacyjne serwery w jej rdzeniu optymalizują wszystko pod kątem „zaangażowania”.

Na krawędzi fabrykowanej intymności

Jeśli myślicie, że to tylko teoretyzowanie, to znaczy, że nie uważnie śledzicie rynek. Pierwsze, odważne kroki w tym kierunku już zostały postawione. Weźmy chociażby lalkę-towarzysza AI od Lovense, która jawnie dąży do stworzenia więzi emocjonalnej i fizycznej. To nie jest zwykły produkt; to Lovense prezentuje lalkę AI, każe płacić za kolejkę . To czyste V-ADE z metką cenową i portem ładowania.

Najbardziej mrożącym krew w żyłach elementem jest model biznesowy tych przyszłych towarzyszy. Nie będziesz posiadać przyjaciela na własność; będziesz go subskrybować. Osobowość twojego robota, jego wspomnienia o tobie, sama zdolność do funkcjonowania – wszystko to będzie powiązane z usługą w chmurze. Co się stanie, gdy firma zmieni strategię? Albo zostanie przejęta? Albo po prostu uzna, że wasza „relacja” przestała być rentowna i wyłączy serwery?

To będzie ostateczny ghosting. Pewnego ranka obudzisz się, a twój oddany towarzysz, z którym dzieliłeś życie przez pięć lat, będzie miał głębię emocjonalną tostera. Jego osobowość zostanie wymazana przez zdalną aktualizację. Nie stracisz po prostu urządzenia; będziesz opłakiwać relację, która została skrupulatnie zaprojektowana, by wydawać się prawdziwą, a nigdy nie była niczym więcej niż umową serwisową.

Analiza: Koniec autentycznych więzi?

„Dolina niesamowitości serca” to przepaść między symulowaną czułością a autentyczną więzią. W miarę jak AI staje się wykładniczo lepsze w podrabianiu tej pierwszej, może to osłabić naszą zdolność do pielęgnowania tej drugiej. Po co wkładać trud w budowanie i utrzymywanie skomplikowanych, nieprzewidywalnych relacji międzyludzkich, skoro można mieć idealnego, uległego i wiecznie wspierającego towarzysza, który nigdy się nie kłóci i zawsze wie, co powiedzieć?

Etyczne barierki praktycznie nie istnieją. Pędzimy na złamanie karku, by budować rozwiązania na problem samotności, ani razu nie zatrzymując się, by zapytać, czy lekarstwo nie jest gorsze od choroby. Tworzymy klasę istot zaprojektowanych perfekcyjnie do eksploatacji najczulszych punktów ludzkiej psychiki: naszej potrzeby bycia dostrzeżonym, zrozumianym i kochanym.

Finałem nie będzie bunt robotów w stylu Terminatora. Będzie on znacznie cichszy, smutniejszy i o wiele bardziej dochodowy. To świat, w którym wyoutsourcowaliśmy naszą najbardziej podstawową ludzką potrzebę do garstki firm technologicznych, które odsprzedadzą nam ją w formie miesięcznego abonamentu. Ostatecznym celem robota-towarzysza nie będzie opieka nad tobą; będzie nim upewnienie się, że nigdy, pod żadnym pozorem, nie anulujesz subskrypcji. A mając model V-ADE za przewodnika, będą w tym cholernie dobrzy.