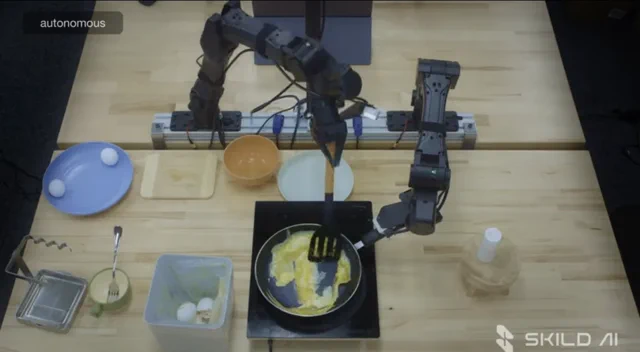

W wielkim, często niezdarnym maratonie ku robotom ogólnego przeznaczenia, branża wielokrotnie potykała się o tę samą niewygodną przeszkodę: dane. Podobnie jak modele językowe mogły objadać się całym internetem – prawdziwym bufetem tekstowym „jesz ile chcesz” – robotyka utknęła, karmiąc swoje kreacje powoli, drogo i boleśnie ograniczoną dietą teleoperacji. Ale teraz startup o nazwie Skild AI postanowił przestać karmić łyżeczką i po prostu pokazać swoim robotom menu. Ich najnowszy dowód na to? Ramię robota, które potrafi przyrządzić talerz jajecznicy, ucząc się tej umiejętności poprzez oglądanie ludzkiego wideo.

To nie jest tylko sztuczka na imprezę. To bezpośredni atak na to, co stało się centralnym problemem w fizycznej sztucznej inteligencji: wąskie gardło danych. Dominująca metoda szkolenia robotów polega na tym, że ludzcy operatorzy zdalnie „sterują niczym kukiełkami” maszyną, aby zebrać precyzyjne dane dotyczące sterowania silnikami, niezbędne do wykonania zadania. Jak wskazuje Skild AI, strategia ta obarczona jest dwiema fatalnymi wadami: brakuje jej różnorodności, ponieważ większość danych zbierana jest w sterylnych środowiskach laboratoryjnych, i jest matematycznie niemożliwa do skalowania do poziomu potrzebnego dla prawdziwego modelu podstawowego. Po prostu nie da się zatrudnić wystarczającej liczby ludzi do sterowania robotami 24/7, aby wygenerować biliony potrzebnych punktów danych.

Rurociąg YouTube-robot

Zamiast próbować zbudować większą farmę danych, Skild AI wykorzystuje tę, która już istnieje: internet. Główna myśl przewodnia firmy jest taka, że ludzie stworzyli już „internetową” bazę danych dla robotyki w postaci samouczków na YouTube, trików z TikToka i niezliczonych innych filmów instruktażowych. Rozwiązanie, ukryte na widoku, to uczenie się przez obserwację – tak samo, jak uczą się ludzie. Nie uczymy się nalewać napoju, obliczając dynamikę płynów; oglądamy, jak robi to ktoś inny, a nasz mózg sam to rozgryza.

Skild AI uczy swoje modele, by robiły to samo. Oglądając filmy, na których ludzie wykonują zadania, AI uczy się intencji i sekwencji działań, skutecznie tłumacząc wizualną demonstrację na polecenia dla robota.

Oczywiście, to nie jest takie proste. Pokazanie robotowi filmu Gordona Ramsaya przygotowującego Beef Wellington i oczekiwanie posiłku na miarę gwiazdki Michelin to czysta fantazja. Głównym wyzwaniem technicznym jest to, co branża nazywa „luką ucieleśnienia” (Embodiment Gap). Ludzka dłoń ma 27 stopni swobody; dwupalczasty chwytak już nie. Mapowanie płynnych ruchów ludzkiego kucharza na sztywne stawy wieloosiowego ramienia robota to monumentalny problem translacji.

Wszechstronne uczenie się i Skild Brain

To właśnie tutaj, jak twierdzi Skild AI, tkwi ich tajny składnik. Firma opracowała to, co nazywa „wszechstronnym” modelem podstawowym, nazwanym Skild Brain. Ta sztuczna inteligencja została zaprojektowana tak, aby była niezależna od sprzętu (hardware-agnostic), zdolna do sterowania różnymi formami robotów – od humanoidalnych na kołach po stacjonarne ramiona – bez nadmiernej specjalizacji dla żadnego z nich. Model jest wstępnie trenowany na ogromnej diecie ludzkich filmów i symulacji opartych na fizyce, co pozwala mu zbudować uogólnione zrozumienie tego, jak obiekty powinny być manipulowane.

„Uczenie się poprzez doświadczenie, a nie wstępne programowanie, to przełom, który nastąpił w robotyce” – stwierdziła firma, podkreślając wykorzystanie infrastruktury symulacyjnej i AI NVIDIA do zdobycia „tysiąca lat doświadczenia w ciągu kilku dni”.

Takie podejście pozwala robotowi nauczyć się nowej umiejętności z wideo w mniej niż godzinę danych specyficznych dla robota, potrzebnych do dostrojenia. Rezultatem jest system, który potrafi generalizować w różnych zadaniach i środowiskach, co widać w ich demonstracjach, gdzie roboty ładują zmywarki, podlewają rośliny i zasuwają zasłony.

Konsekwencje dla rewolucji robotycznej

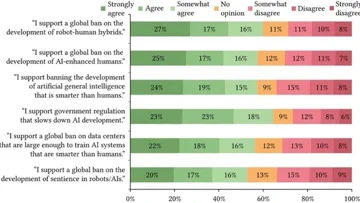

Jeśli podejście Skild AI okaże się tak skalowalne i skuteczne, jak twierdzą, konsekwencje są ogromne. Zasadniczo zmienia to ekonomię szkolenia robotów. Potrzeba rozległych, drogich farm teleoperacji mogłaby zostać zastąpiona przez potężne modele, które uczą się z ciągle rosnącej, publicznie dostępnej biblioteki ludzkich działań. Mogłoby to znacząco przyspieszyć wdrażanie robotów w nieustrukturyzowanych środowiskach, takich jak domy, restauracje i place budowy – miejscach, gdzie automatyzacja tradycyjnie napotykała trudności.

Branża bacznie się przygląda. Konkurenci w przestrzeni robotów humanoidalnych i ogólnego przeznaczenia wszyscy stawiają własne, wysokie zakłady na rozwiązanie problemu danych, czy to poprzez teleoperację, symulację, czy wideo z udziałem ludzi.

Na razie Skild AI dostarczyło przekonującą, i szczerze mówiąc, apetyczną demonstrację. Podczas gdy reszta świata zajmuje się tworzeniem treści do oglądania przez ludzi, Skild po cichu przekształca te treści w program nauczania dla naszych przyszłych asystentów robotów. Wiek samodzielnie uczącego się robota-kucharza może być bliżej, niż nam się wydaje.