Net toen je dacht dat de AI-wereld verzadigd was met “world models”, komt NVIDIA met een model dat daadwerkelijk het verschil maakt in de fysieke wereld. Maak kennis met DreamZero, een robot-fundatiemodel met 14 miljard parameters dat een simpele tekstuele opdracht kan interpreteren en vervolgens een taak uitvoert waar het nooit expliciet voor is getraind. NVIDIA noemt het een “World Action Model” (WAM). De kern van de zaak? Het systeem “droomt” de gewenste toekomst in videopixels, waarna de robot zelf uitzoekt welke motorische handelingen nodig zijn om die droom werkelijkheid te maken.

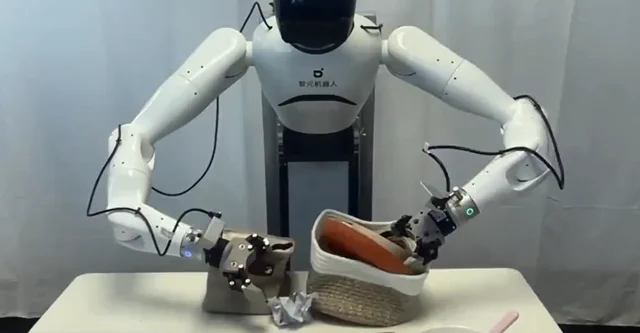

Wat DreamZero echt tot een gamechanger maakt, is het verbijsterende aanpassingsvermogen. Het model kan zijn kennis overdragen naar een compleet nieuwe, onbekende robot met slechts 55 demonstratietrajecten. Dat komt neer op ongeveer 30 minuten waarin een mens de machine op afstand bestuurt. Dit is een monumentale sprong in efficiëntie vergeleken met de honderden uren aan demonstraties die voorheen nodig waren. Volgens het onderzoek van NVIDIA presteert DreamZero meer dan twee keer zo goed als de huidige state-of-the-art Vision-Language-Action (VLA) modellen wanneer het wordt losgelaten in nieuwe omgevingen. Op de officiële projectwebsite is te zien hoe de robot alles aanpakt, van het losmaken van veters tot het schudden van handen.

Het project heeft twee cruciale inzichten opgeleverd die de gevestigde orde in robotica-training op zijn kop zetten. Ten eerste: voor WAM’s is diversiteit in data vele malen belangrijker dan het eindeloos herhalen van dezelfde taak. Ten tweede: het hardnekkige probleem van kennisoverdracht tussen verschillende robotlichamen (cross-embodiment) blijkt het beste te worden opgelost via pixels. Video is, zo blijkt, de universele vertaler. Het maakt een significante overdracht van vaardigheden mogelijk tussen robots onderling, en zelfs van mens naar robot. Om de innovatie te versnellen, zijn het model en de bijbehorende gewichten open-source beschikbaar gesteld via GitHub.

Waarom is dit belangrijk?

DreamZero markeert een fundamentele verschuiving in hoe we robots leren om te gaan met de wereld. In plaats van een robot moeizaam te programmeren voor elke denkbare taak — een doodlopende weg die leidt tot fragiele systemen — beweegt de industrie richting generalistische modellen die on-the-fly kunnen leren en adapteren. Door de wetten van de fysica te begrijpen via video, kunnen WAM’s gedrag genereren voor taken die ze nog nooit hebben gezien, zoals het losmaken van een veter, zelfs als die specifieke vaardigheid niet in de trainingsset zat.

De onderzoekers vergelijken hun doorbraak bescheiden met het “GPT-2 tijdperk” van de robotica. Het is nog niet perfect en mist de robuustheid van een GPT-3, maar het is een krachtige fundamentele stap. Door robots te bouwen die kunnen leren van diverse bronnen, waaronder video’s van mensen, en die zich binnen enkele minuten aanpassen aan nieuwe hardware, verlaagt NVIDIA de drempel voor het inzetten van robots in complexe, alledaagse scenario’s aanzienlijk. Het gaat er niet langer om een robot een specifiek kunstje te leren; het gaat erom hem het vermogen te geven om elke baan te leren.