Oude honden, nieuwe kunstjes: robots leren menselijke bewegingen

Wie zegt dat je een oude hond geen nieuwe kunstjes kunt leren? In dit geval is het geen hond, maar een vierpotige robot die meer leert dan alleen apporteren. Dankzij een baanbrekende samenwerking tussen Carnegie Mellon University, Google DeepMind en Bosch maken onze vierbenige vrienden een grote sprong voorwaarts met een systeem genaamd Human2LocoMan. Dit is niet zomaar een wandeling in het park; het is een sprong naar de toekomst van de robotica!

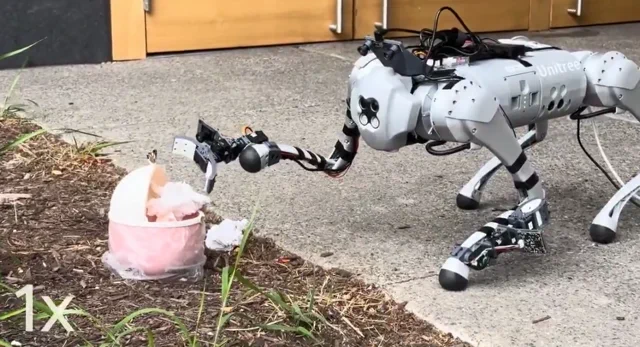

Het geheime ingrediënt? Menselijke data. Door robotbeleid vooraf te trainen op menselijke bewegingen voordat ze fijnafstemming krijgen op echte hardware, hebben deze slimme onderzoekers een viervoeter gecreëerd die niet alleen snel en wendbaar is, maar ook objecten met finesse kan manipuleren. Stel je een robotische hond voor die niet alleen een bal kan achtervolgen, maar hem ook kan oppakken, zijn speelgoed kan organiseren en misschien zelfs licht huishoudelijk werk kan doen. De afbeelding toont een van deze mechanische wonderen die zijn arm uitstrekt om te interacteren met een object op de grond, wat zijn nieuw verworven behendigheid demonstreert.

Dit is niet zomaar een trucje; het is een significante sprong voorwaarts in de robotica. Het Human2LocoMan-systeem, aangedreven door een Modularized Cross-Embodiment Transformer (MXT), leert van zowel menselijke als robotdemonstraties. Het resultaat? Een vermindering van 50% in benodigde robotdata en een indrukwekkende verbetering van 80% in slaagpercentages bij het aanpakken van onbekende omgevingen. Het is alsof je je robot naar een spoedcursus “Hoe Meer Menselijk Te Zijn” stuurt en hem ziet afstuderen met onderscheiding. Wie weet zien we met vaardigheden als deze binnenkort vierpotige robots taken uitvoeren die we nooit voor mogelijk hadden gehouden. Robo-barista’s, iemand?