Google DeepMind ha appena calato un asso che potrebbe cambiare le regole del gioco nella robotica: si tratta di Gemini Robotics-ER 1.6, l’ultima evoluzione del suo modello di “Embodied Reasoning” (ragionamento incarnato). L’obiettivo? Iniettare una massiccia dose di buon senso digitale nelle macchine, permettendo ai robot di smettere di seguire pedissequamente dei binari predefiniti per iniziare a capire davvero il mondo fisico che li circonda.

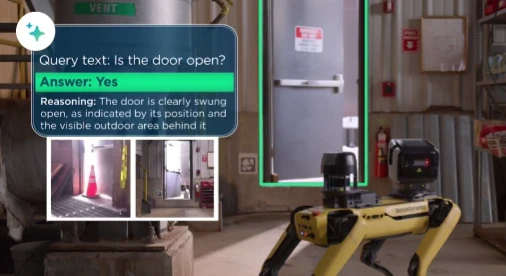

Il vero salto di qualità di Gemini Robotics-ER 1.6 sta nella sua raffinata comprensione visiva e spaziale, che trova la sua massima espressione nella capacità di “puntamento”. Immaginate di chiedere a un robot di trovare un attrezzo specifico in un’officina nel caos più totale: ora il modello è in grado di identificare, contare e isolare con precisione chirurgica l’oggetto richiesto, ignorando tutto il “rumore” circostante. Non è solo una questione di vista, ma di logica spaziale pura: il robot può mappare traiettorie per una presa perfetta o interpretare comandi relazionali complessi come “sposta la chiave inglese nella cassetta degli attrezzi”. Il modello arriva persino a ragionare sui vincoli fisici, distinguendo quali oggetti sono abbastanza piccoli da entrare in un determinato contenitore.

Il nuovo aggiornamento affronta anche uno dei problemi storici della robotica: capire quando un lavoro è effettivamente finito. Grazie a un sistema avanzato di ragionamento multi-prospettiva, Gemini Robotics-ER 1.6 è in grado di fondere i flussi video provenienti da diverse telecamere — ad esempio una fissa dall’alto e una montata sul polso del robot — per costruire una visione d’insieme coerente. Questo evita che il robot finisca in un loop infinito o fallisca un compito solo perché un oggetto è momentaneamente coperto da un altro punto di vista.

Perché è una notizia fondamentale?

Qui non parliamo del solito piccolo passo avanti nelle prestazioni; stiamo gettando le basi per una vera autonomia. La capacità di leggere indicatori analogici, integrare diversi feed video e comprendere relazioni spaziali complesse è ciò che trasforma un braccio meccanico da fabbrica in un robot capace di operare sul campo. Secondo l’annuncio ufficiale di DeepMind, questo è il loro modello robotico più sicuro di sempre.

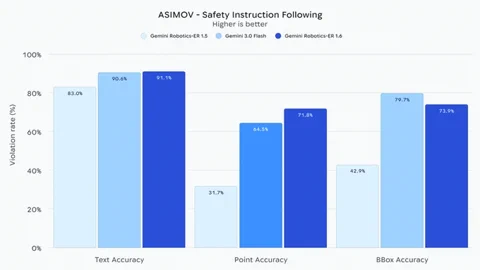

L’aspetto forse più critico è che Gemini Robotics-ER 1.6 dimostra una “capacità sostanzialmente migliorata” nel rispettare i vincoli di sicurezza fisica. Capisce al volo istruzioni come evitare il contatto con i liquidi o non sollevare carichi superiori ai 20 kg. Rispetto al modello baseline Gemini 3.0 Flash, è risultato il 10% più efficace nel percepire i rischi di infortuni umani analizzando i video. Questo focus ossessivo sulla sicurezza e sul ragionamento applicato al mondo reale è il tassello mancante per portare i robot a collaborare stabilmente con noi in ambienti imprevedibili. Il modello è già a disposizione degli sviluppatori tramite l’API Gemini e Google AI Studio.