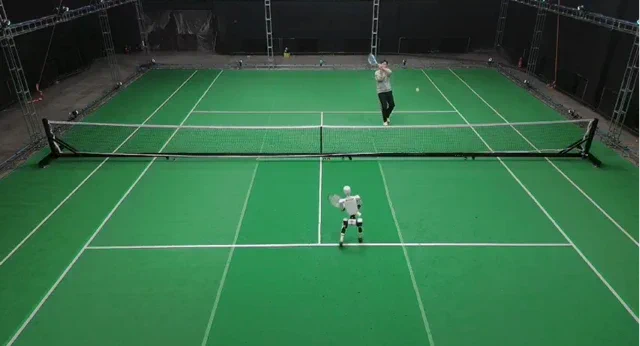

In un colpo di scena che non stupirà affatto chi segue da vicino l’evoluzione dell’automazione, un ricercatore ha creato un robot capace di apprendere una nuova abilità così bene da sconfiggere, in breve tempo, il suo stesso insegnante. Lo sport in questione è il tennis e il progetto, battezzato LATENT, ha addestrato un umanoide a giocare partendo non da dati professionali e immacolati, ma da clip di movimenti umani imperfetti. Il risultato? Un robot capace di reggere scambi prolungati senza battere ciglio.

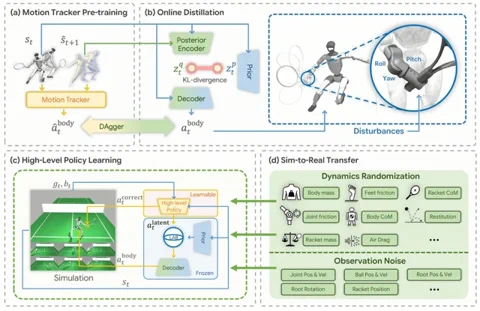

Il cuore del progetto, guidato dai ricercatori della Tsinghua University e di Galbot Inc., affronta una delle sfide più ostiche della robotica: insegnare movimenti complessi e agili senza un manuale d’istruzioni perfetto. Il sistema apprende quello che viene definito uno “spazio d’azione latente” a partire da frammenti di movimenti tennistici umani tutt’altro che impeccabili. Il segreto sta in una “policy” di intelligenza artificiale di alto livello che agisce come un coach digitale, correggendo e assemblando queste abilità primitive grezze per riuscire a rimandare la pallina dall’altra parte della rete. Tutto il processo viene perfezionato in simulazione prima di essere trasferito su un vero umanoide Unitree G1 attraverso la tecnica del sim-to-real transfer.

I risultati parlano chiaro, o meglio, lo fa il tabellone dei punti. Secondo l’autore principale, Zhikai Zhang, la curva di apprendimento è stata impressionante. “Il primo giorno di test sul campo, il robot non riusciva a rispondere a un singolo servizio”, ha dichiarato Zhang. “L’ultimo giorno del progetto, non riuscivo più a batterlo.” Per chi volesse spulciare i dettagli tecnici o magari addestrare il proprio campione personale, il team ha reso pubblici i dettagli e il codice. Link: Pagina del Progetto e Link: Repository GitHub.

Perché è un punto di svolta?

Non si tratta solo di creare un compagno d’allenamento per tennisti solitari. La vera innovazione del sistema LATENT risiede nella sua capacità di imparare da dati “sporchi” e incompleti. Di solito, l’addestramento dei robot richiede dataset curati meticolosamente, costosi e lunghi da produrre. Imparando a correggere e combinare esempi imperfetti, questo approccio potrebbe accelerare drasticamente il modo in cui insegniamo alle macchine a svolgere compiti complessi nel mondo reale. È un passo avanti fondamentale verso robot capaci di imparare “sul campo” in ambienti imprevedibili — dai magazzini logistici alle zone colpite da disastri — senza bisogno di una dimostrazione perfetta ogni singola volta.