L’addestramento dei robot è una routine estenuante, un ciclo infinito di reset manuali e supervisione costante che metterebbe alla prova la pazienza di chiunque. Per ogni singola azione che un robot riesce a imparare, c’è quasi sempre un essere umano che ha dovuto ripristinare la scena decine di volte dopo ogni fallimento. Un nuovo framework chiamato RoboClaw punta a porre fine a questo incubo, insegnando ai robot l’unica abilità che è sempre mancata: come pulire e rimettere in ordine dopo aver sbagliato.

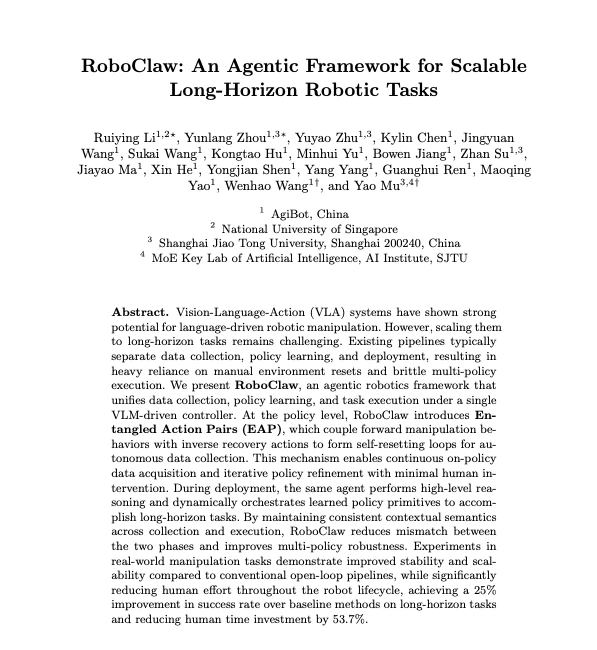

Sviluppato dai ricercatori di AgiBot, della National University of Singapore e della Shanghai Jiao Tong University, RoboClaw introduce un concetto brutalmente semplice quanto efficace: le Entangled Action Pairs (EAP), ovvero coppie di azioni intrecciate. L’idea centrale è che per ogni abilità “diretta” che un robot apprende — come inserire un rossetto nel suo supporto — impari simultaneamente l’abilità inversa di “annullamento” (undo), ovvero estrarre il rossetto. Questi due comportamenti creano un loop di auto-ripristino che permette al robot di esercitarsi in un compito, resettare l’ambiente autonomamente e ripetere il processo, raccogliendo dati senza sosta. Il tutto senza bisogno di un babysitter umano.

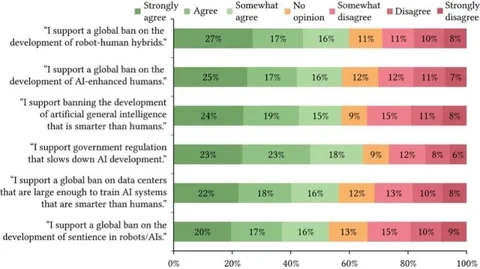

I risultati sono, onestamente, sbalorditivi. I ricercatori riportano una riduzione di 8 volte degli interventi umani durante l’addestramento, un risparmio di tempo del 2,16x per ogni dataset e un tasso di successo superiore del 25% in compiti complessi e multi-fase rispetto ai modelli standard. Il sistema è stato testato su un compito di organizzazione di una postazione trucco, dove ha imparato autonomamente a maneggiare e posizionare vari oggetti, correggendo i propri errori lungo il percorso.

Perché è una svolta?

Il vero punto di rottura non è solo il loop di auto-reset. È il fatto che lo stesso agente che addestra il robot è anche quello che lo gestisce sul campo. La maggior parte dei sistemi robotici attuali utilizza pipeline completamente separate e scollegate per la raccolta dati, l’addestramento del modello e l’esecuzione nel mondo reale. RoboClaw unifica queste tre fasi sotto un unico controller guidato da un Vision-Language-Model (VLM).

Ciò significa che quando il robot fallisce un compito nel mondo reale, quel fallimento non è solo un errore che richiede l’intervento umano; diventa un nuovo dato di addestramento che viene iniettato direttamente nel sistema. Il robot impara dai propri errori “sul campo”, creando un sistema a circuito chiuso che migliora continuamente nel tempo. Questo approccio sposta l’ago della bilancia dalla robotica rigida e pre-programmata verso sistemi realmente agentici, capaci di apprendere e adattarsi in contesti non strutturati.