Nella ricerca incessante per rendere i robot umanoidi meno goffi, sta emergendo un nuovo paradigma: trasformare gli esseri umani in veri e propri maestri burattinai in tempo reale. L’acquisizione di dati tramite esoscheletro sta permettendo agli operatori di pilotare direttamente i robot per eseguire compiti complessi, catturando un fiume di dati ad alta fedeltà che le simulazioni possono solo sognare. Questo approccio mira a risolvere il processo costoso e lento di raccolta di dati di addestramento nel mondo reale.

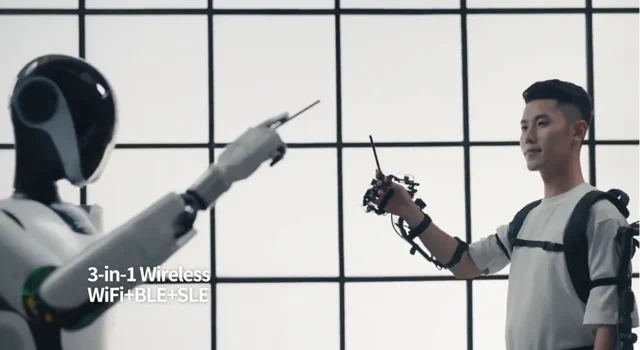

Entra in scena Daimon Robotics, un’azienda con sede a Hong Kong, che ha sviluppato il DM-EXton, un sistema di teleoperazione indossabile progettato proprio per questo scopo. Un operatore che indossa la tuta leggera può controllare un umanoide con elevata precisione, mentre i sensori multimodali del robot—che catturano visione, forza e un feedback tattile cruciale—registrano ogni sfumatura dell’interazione. Questo processo genera il tipo di dati disordinati e autentici essenziali per addestrare modelli di AI robusti, superando efficacemente il divario notoriamente difficile del “sim-to-real”.

Perché è importante?

Questo non è solo un sofisticato telecomando; è un motore di generazione dati. Creando un ciclo chiuso di abilità umana -> azione robotica -> addestramento del modello, le aziende possono costruire rapidamente modelli comportamentali sofisticati da un ricco set di dati. Mentre l’obiettivo immediato è avere robot più intelligenti, la tecnologia ha chiari risvolti per il lavoro remoto in ambienti pericolosi, l’assistenza e la produzione di precisione. Con Daimon Robotics che presenterà il suo ultimo sistema DM-EXton2 al CES 2026, l’industria sta chiaramente scommettendo che il modo più veloce per costruire un umano artificiale è iniziare con uno vero.