Proprio quando pensavi che il circo mediatico sull’intelligenza artificiale non potesse diventare più surreale, una startup australiana ha deciso di mandare in pensione le GPU e collegare l’IA direttamente a un cervello biologico vivente. O quasi. Cortical Labs, l’azienda biotech che in precedenza aveva insegnato a una coltura di circa 800.000 neuroni umani a giocare al leggendario Pong, ha deciso di alzare l’asticella. Dopo aver addestrato con successo un nuovo “set” di 200.000 neuroni a navigare tra i corridoi infestati di demoni di DOOM, ora hanno cablato il loro “DishBrain” a un Large Language Model (LLM).

Esatto: vere cellule cerebrali umane, che emettono impulsi elettrici su un chip di silicio, stanno ora scegliendo le parole che un’IA pronuncia. Non si tratta del solito piccolo passo avanti nel machine learning; è un salto bizzarro, affascinante e onestamente un po’ inquietante nel mondo del “wetware” e dell’informatica biologica. E, a dire il vero, fa sembrare il vostro chatbot medio avanzato quanto una calcolatrice tascabile degli anni ‘90.

Dai pixel di Pong agli inferi di DOOM

Per capire come siamo arrivati al punto in cui delle cellule cerebrali partecipano alla stesura di un testo, dobbiamo guardare ai “grandi successi” di Cortical Labs. Nel 2022, il team di Melbourne balzò agli onori della cronaca con l’esperimento “DishBrain”. Coltivarono neuroni su una matrice di microelettrodi capace sia di stimolare le cellule che di leggerne l’attività. Inviando segnali elettrici per indicare la posizione della pallina in Pong, i neuroni impararono a rispondere in modo da controllare la racchetta, dimostrando un apprendimento orientato all’obiettivo in soli cinque minuti. Era la prova schiacciante che l’intelligenza biologica sintetica non era solo teoria.

Ma Pong è roba da principianti. Nel mondo tech esiste un mantra intramontabile per giudicare ogni nuovo hardware: “Può far girare DOOM?”. E così, Cortical Labs ha raccolto la sfida. Il salto dal mondo bidimensionale di Pong all’ambiente 3D di DOOM è immenso: richiede navigazione spaziale, rilevamento delle minacce e capacità decisionale rapida. Eppure, i neuroni hanno imparato. Il flusso video del gioco è stato tradotto in pattern di stimolazione elettrica, e le risposte dei neuroni sono state decodificate in azioni di gioco, come muoversi e sparare. Anche se la performance somigliava più a quella di un principiante maldestro che a un pro-gamer, ha dimostrato che il sistema può gestire compiti dinamici estremamente complessi.

Un “fantasma biologico” dentro l’LLM

Dopo aver conquistato i classici dei videogiochi, il passo successivo è stato, a quanto pare, dare voce ai neuroni. L’ultimo esperimento, mostrato da figure di spicco come l’evangelista tech Robert Scoble, rivela che le cellule cerebrali sono state interfacciate con un LLM. Invece di muovere una racchetta o un marine spaziale, gli impulsi elettrici generati dai neuroni vengono ora utilizzati per selezionare ogni singolo token — che sia una lettera o una parola — generato dall’intelligenza artificiale.

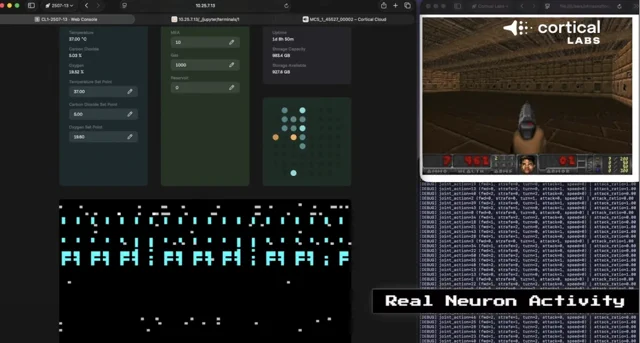

Un video in anteprima mostra il processo in azione: una griglia visualizza i canali stimolati e il relativo feedback dei neuroni mentre “decidono” collettivamente il pezzo di testo successivo. È uno sguardo crudo e senza filtri sulla materia biologica che esegue un compito cognitivo che, fino a ieri, era dominio esclusivo di algoritmi complessi in esecuzione su hardware energivori.

“Abbiamo dimostrato di poter interagire con neuroni biologici vivi in modo tale da spingerli a modificare la propria attività, portando a qualcosa che somiglia all’intelligenza”, ha dichiarato il Dr. Brett Kagan, Chief Scientific Officer di Cortical Labs, commentando i loro lavori precedenti.

Questo nuovo sviluppo porta l’interazione su un piano completamente diverso. Reagire a una pallina che rimbalza è un conto; partecipare attivamente alla costruzione del linguaggio è tutta un’altra storia.

Perché ostinarsi con i cervelli in provetta?

A questo punto, la domanda sorge spontanea: perché prendersi il disturbo di mantenere in vita 200.000 neuroni in una capsula di Petri quando una GPU di fascia alta può far girare un LLM senza troppi drammi? La risposta sta nell’efficienza e nei limiti strutturali del silicio. Il cervello umano compie calcoli sbalorditivi consumando circa 20 watt — l’equivalente di una lampadina a basso consumo. Un supercomputer che cercasse di simulare la stessa attività richiederebbe milioni di volte più energia.

Cortical Labs e altri pionieri del settore scommettono sulla possibilità di imbrigliare questa incredibile efficienza energetica. I sistemi biologici eccellono nel calcolo parallelo e nell’apprendimento adattivo in modi che i computer tradizionali, deterministici e binari, faticano a replicare. Fondendo neuroni vivi e silicio, stanno creando un’architettura informatica ibrida che un giorno potrebbe alimentare sistemi capaci di apprendere più velocemente consumando una frazione dell’energia attuale.

Non si tratta solo di costruire un chatbot migliore. Il team di Cortical Labs, guidato dal CEO Dr. Hon Weng Chong, intravede un futuro in cui questa tecnologia rivoluzionerà la robotica, la medicina personalizzata e la scoperta di nuovi farmaci. Immaginate un robot che non si limita a eseguire comandi pre-programmati, ma impara e si adatta a un nuovo ambiente con la fluidità cognitiva di un sistema biologico. O pensate alla possibilità di usare i neuroni di un paziente su un chip per testare l’efficacia di diversi farmaci contro malattie neurologiche come l’epilessia.

La strada è ancora lunga. I sistemi biologici sono complessi e spesso imprevedibili, ben lontani dalla rassicurante coerenza del silicio. Ma come ha dimostrato Cortical Labs, un ammasso di cellule in una vaschetta è già passato dal giocare ai videogiochi al “parlare”. L’idea che questi stessi neuroni possano un giorno controllare un robot non è più fantascienza: è semplicemente il prossimo punto sulla tabella di marcia. Un pensiero che riesce a essere, simultaneamente, terrificante ed esaltante.