Siamo nel 2035. Siete alla guida di un impianto industriale dove 300 robot umanoidi si muovono in un silenzio operoso, eseguendo compiti con precisione chirurgica. C’è solo un piccolo, frustrante problema: avete 300 telecomandi diversi e il vostro tentativo di assemblarli in un mech gigante è stato gentilmente (ma fermamente) stroncato dall’ufficio Risorse Umane. La logistica necessaria per gestire una forza lavoro robotica su vasta scala è uno degli ostacoli più grandi, sebbene meno affascinanti, verso il nostro futuro automatizzato. E se poteste semplicemente… pensare, e vedere i robot obbedire?

Non è l’incipit di un thriller sci-fi, ma il problema concreto che un nuovo progetto open-source chiamato Kinexus sta cercando di risolvere. Mentre il settore si sposta verso interfacce cervello-computer (BCI) invasive alla Neuralink, Kinexus sceglie una via più accessibile: utilizza un visore EEG non invasivo per tradurre i pensieri e i comandi vocali dell’utente in azioni reali per una flotta di umanoidi. Meno chirurgia, più pragmatismo: l’obiettivo è costruire un ponte scalabile tra la mente umana e la manovalanza robotica.

La crisi di scalabilità nel controllo dei robot

Mentre fabbriche e centri logistici accelerano l’adozione di umanoidi, si scontrano con una sfida operativa titanica. Il modello “un operatore per ogni robot” semplicemente non regge il passo della crescita. I metodi di controllo attuali si affidano a interfacce software complesse o a ingombranti “teach pendant” che richiedono una programmazione individuale e diretta. È un collo di bottiglia che rischia di annullare i vantaggi di efficienza offerti dai robot. Gestire una manciata di macchine è complesso; gestirne centinaia è un incubo logistico.

In questo scenario, un centro di comando centralizzato e intuitivo diventa fondamentale. L’industria ha bisogno di un “piano di controllo” per i propri asset fisici, un sistema che permetta a un singolo supervisore umano di orchestrare un’intera flotta senza soluzione di continuità. Kinexus scommette sull’interfaccia più intuitiva che abbiamo a disposizione sin dalla nascita: il nostro cervello.

Kinexus: il cervello è la nuova dashboard

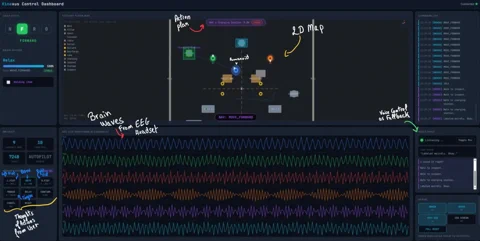

Fondamentalmente, Kinexus è una dashboard di controllo che funge da interprete in tempo reale tra l’utente e il suo esercito di robot. Sviluppato dall’esperto di AI Mourad Ouazmour e scritto principalmente in Python, il sistema è concepito per essere il sistema nervoso centrale dell’automazione industriale. Visualizza i segnali cerebrali provenienti da un visore EEG commerciale, li traduce in comandi discreti e mappa l’intero ambiente di fabbrica per garantire la massima consapevolezza situazionale.

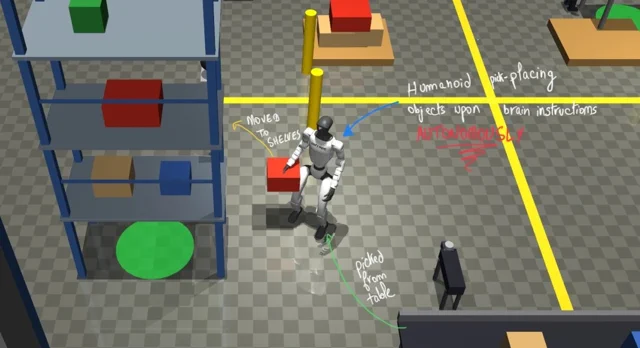

Il sistema di controllo è sorprendentemente diretto. Come spiegato dallo sviluppatore, un utente potrebbe stringere il pugno destro per far girare un robot a destra, stringerli entrambi per farlo camminare in avanti, o persino toccare il palato con la lingua per cambiare modalità operativa. La dashboard mostra tutto questo in azione:

- EEG Live Waveform: Un flusso in tempo reale dell’attività elettrica cerebrale, suddiviso in diversi canali.

- Pannello Methods: Il motore di traduzione, dove specifici input mentali (come immaginare di stringere un pugno) vengono mappati su azioni robotizzate come “MOVE_LEFT” o “MOVE_FORWARD”.

- Mappa della fabbrica: Uno schema 2D che indica la posizione di ogni umanoide, il suo stato e il piano d’azione corrente.

- Voice Fallback: Per compiti autonomi più complessi, il sistema bypassa la “telepatia” diretta. L’utente può semplicemente dire: “Prendi la scatola dal nastro trasportatore e mettila sul pallet 2”, e l’umanoide designato navigherà ed eseguirà l’intera sequenza in autonomia.

Ambizione sci-fi e realtà open-source

Sebbene il controllo dei robot tramite EEG non invasivo non sia una novità assoluta, è la sua applicazione nella gestione di intere flotte a rendere Kinexus così interessante. Finora, la ricerca sulle BCI basate su EEG si è concentrata soprattutto sull’assistenza a persone con disabilità o sul controllo di singoli robot, con tassi di precisione che oscillano tra il 70% e il 90% a seconda del metodo. Kinexus punta a portare questa tecnologia fuori dai laboratori e direttamente nei capannoni industriali.

La scelta di rendere Kinexus un progetto open-source su GitHub è forse il suo tratto più rivoluzionario. Democratizza l’accesso a un paradigma di controllo avanzato: non è un prodotto chiuso di un colosso della robotica, ma un kit di strumenti a disposizione di chiunque voglia sperimentare, migliorare o integrare hardware come la piattaforma OpenBCI. Questo invita una comunità globale di sviluppatori a risolvere i problemi intrinseci del controllo EEG, come il rumore del segnale e la necessità di calibrazioni specifiche per ogni utente.

Naturalmente, la strada che porta da un repository su GitHub a una fabbrica controllata dal pensiero è ancora lunga. L’EEG non invasivo ha una risoluzione inferiore rispetto ai metodi chirurgici, e raggiungere l’affidabilità superiore al 99% richiesta dalle applicazioni industriali è un’impresa monumentale. Tuttavia, Kinexus non sta vendendo un prodotto finito; sta lanciando un’idea potente e audace. Suggerisce un futuro in cui la supervisione umana in ambienti automatizzati non sarà più una frenetica pressione di tasti, ma un esercizio di puro intento strategico. Per ora, è uno sguardo affascinante su un domani in cui gestire centinaia di robot potrebbe non richiedere alcuno sforzo più grande di un semplice pensiero.