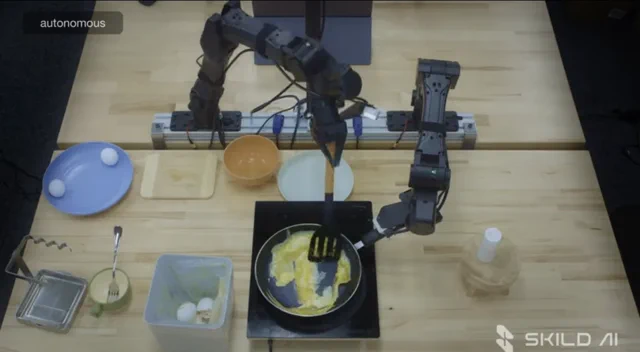

Nel grande, spesso goffo, sprint verso i robot per scopi generali, l’industria è ripetutamente inciampata sullo stesso scomodo ostacolo: i dati. Mentre i modelli linguistici si sono potuti abbuffare dell’intero internet—un vero e proprio buffet a volontà di testo—la robotica è rimasta bloccata a imboccare le sue creazioni con la dieta lenta, costosa e dolorosamente limitata della teleoperazione. Ma ora, una startup di nome Skild AI ha deciso di smettere di imboccare e semplicemente mostrare il menu ai suoi robot. La loro ultima prova? Un braccio robotico che può preparare al volo un piatto di uova strapazzate dopo aver imparato l’abilità guardando un video umano.

Questo non è solo un trucco da salotto. È un assalto diretto a quello che è diventato il problema centrale nell’AI fisica: il collo di bottiglia dei dati. Il metodo prevalente per addestrare i robot coinvolge operatori umani che “manovrano” a distanza una macchina per raccogliere i dati precisi di controllo motorio necessari per un compito. Come sottolinea Skild AI, questa strategia è afflitta da due difetti fatali: manca di diversità, poiché la maggior parte dei dati viene raccolta in ambienti di laboratorio sterili, ed è matematicamente impossibile da scalare al livello necessario per un vero modello fondamentale. Semplicemente non puoi assumere abbastanza umani per guidare i robot 24 ore su 24, 7 giorni su 7, per generare i trilioni di punti dati richiesti.

La pipeline da YouTube al robot

Invece di tentare di costruire una più grande “farm” di dati, Skild AI sta attingendo a una che esiste già: internet. L’intuizione fondamentale dell’azienda è che gli umani hanno già creato un dataset “su scala internet” per la robotica sotto forma di tutorial di YouTube, “hack” di TikTok e innumerevoli altri video didattici. La soluzione, nascosta in bella vista, è l’apprendimento osservazionale—lo stesso modo in cui imparano gli umani. Non impariamo a versare un drink calcolando la dinamica dei fluidi; guardiamo qualcun altro farlo e il nostro cervello capisce il resto.

Skild AI sta insegnando ai suoi modelli a fare lo stesso. Guardando video di umani che eseguono compiti, l’AI apprende l’intento e la sequenza di azioni, traducendo efficacemente una dimostrazione visiva in comandi robotici.

Certo, non è così semplice. Mostrare a un robot un video di Gordon Ramsay che prepara un Beef Wellington e aspettarsi un pasto da stella Michelin è pura fantasia. La sfida tecnica principale è ciò che l’industria chiama l’“Embodiment Gap”. Una mano umana ha 27 gradi di libertà; una pinza a due dita no. Mappare i movimenti fluidi di uno chef umano sulle giunture rigide di un braccio robotico multi-asse è un problema di traduzione monumentale.

Apprendimento omni-corporeo e lo Skild Brain

È qui che Skild AI afferma risieda il suo ingrediente segreto. L’azienda ha sviluppato quello che chiama un modello fondamentale “omni-corporeo”, soprannominato lo Skild Brain. Questa AI è progettata per essere agnostica all’hardware, capace di controllare varie forme di robot—dagli umanoidi su ruote ai bracci stazionari—senza essere eccessivamente specializzata per uno solo. Il modello è pre-addestrato con una dieta massiccia di video umani e simulazioni basate sulla fisica, permettendogli di costruire una comprensione generalizzata di come gli oggetti dovrebbero essere manipolati.

«Imparare dall’esperienza, e non dalla pre-programmazione, è il cambiamento epocale avvenuto nella robotica», ha dichiarato l’azienda, sottolineando il suo utilizzo dell’infrastruttura di simulazione e AI di NVIDIA per acquisire «un millennio di esperienza in pochi giorni».

Questo approccio permette al robot di imparare una nuova abilità da video con meno di un’ora di dati specifici per il robot per la messa a punto. Il risultato è un sistema che può generalizzare tra diverse attività e ambienti, come si vede nelle loro demo di robot che caricano lavastoviglie, innaffiano piante e tirano tende.

Implicazioni per la rivoluzione robotica

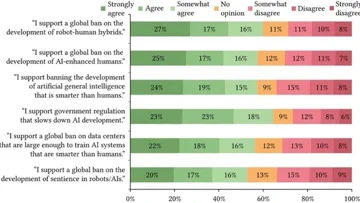

Se l’approccio di Skild AI si dimostrerà scalabile ed efficace come sostiene, le implicazioni sono enormi. Altera fondamentalmente l’economia dell’addestramento dei robot. La necessità di vaste e costose “farm” di teleoperazione potrebbe essere sostituita da modelli potenti che imparano da una libreria di attività umane in continua crescita e pubblicamente disponibile. Questo potrebbe accelerare drasticamente l’implementazione di robot in ambienti non strutturati come case, ristoranti e cantieri—luoghi dove l’automazione ha tradizionalmente faticato.

L’industria sta prendendo nota. I concorrenti nel settore dei robot umanoidi e per scopi generali stanno tutti puntando le loro fiches sul risolvere il problema dei dati, sia tramite teleoperazione, simulazione o video umani.

Per ora, Skild AI ha consegnato una dimostrazione convincente, e francamente dall’aspetto delizioso. Mentre il resto del mondo è impegnato a creare contenuti da guardare per gli umani, Skild sta silenziosamente trasformando quel contenuto in un curriculum per i nostri futuri assistenti robotici. L’era dello chef robotico autodidatta potrebbe essere più vicina di quanto pensiamo.