Diciamoci la verità: quando si pensa a Microsoft, la mente corre subito ai software che fanno girare i desktop di mezzo mondo, non certo ai robot che un giorno potrebbero costruirli. La storia dell’azienda di Redmond nella robotica è stata, per usare un eufemismo, intermittente. Molti di noi conservano ancora un angolo polveroso della memoria riservato a Microsoft Robotics Developer Studio, quel tentativo del 2006 di creare un “Windows per robot” che finì per sgonfiarsi come un soufflé. Era un’idea nobile, ma si trattava di una piattaforma alla ricerca di un problema che il mercato non era ancora pronto a risolvere.

Ma benvenuti nel 2026. Il mondo è cambiato radicalmente. Microsoft, potenziata dalla sua profonda alleanza con OpenAI, non è più solo un gigante del software: è un colosso dell’intelligenza artificiale. E ora sta tentando un secondo affondo nella robotica, molto più ambizioso del primo. Questa volta non si tratta di fornire un semplice kit per sviluppatori, ma di costruire un unico cervello universale — un foundation model per il mondo fisico capace di gestire qualsiasi cosa, da un braccio meccanico in fabbrica a un assistente umanoide domestico. L’obiettivo è colmare finalmente il divario tra intelligenza digitale e azione fisica, una sfida nota come embodied AI (IA incarnata).

Dai modelli linguistici alla “Physical AI”

Per anni, i robot sono stati incredibilmente efficienti in ambienti strutturati. Una catena di montaggio automobilistica è il paradiso della robotica: ogni componente è in un punto prevedibile, ogni compito è ripetitivo e il margine di errore è nullo. Ma non appena tiri fuori quel robot dalla sua gabbia e lo scaraventi nel caos imprevedibile del mondo umano, si trasforma in un costosissimo fermacarte. È esattamente questo il problema che Microsoft vuole risolvere.

L’idea portante dell’azienda è la creazione della cosiddetta “Physical AI”, sfruttando gli stessi principi che rendono così potenti modelli come GPT-4. La nuova punta di diamante di questa iniziativa è Rho-alpha, il primo modello robotico di Microsoft derivato dalla serie Phi di modelli vision-language. Come spiega Ashley Llorens, VP di Microsoft Research, si tratta di permettere ai sistemi di “percepire, ragionare e agire con una crescente autonomia al fianco degli esseri umani in contesti molto meno strutturati”.

In sostanza, vogliono costruire un modello che non si limiti a capire il comando “prendi la scatola blu”, ma che comprenda anche la fisica necessaria per sollevarla, che abbia il “buon senso” di non schiacciarla e la capacità di adattarsi se la scatola è leggermente fuori posto. È il passaggio da istruzioni rigide e pre-programmate a un’intelligenza fluida e adattiva.

Il vantaggio VLA+: tutto merito del tatto

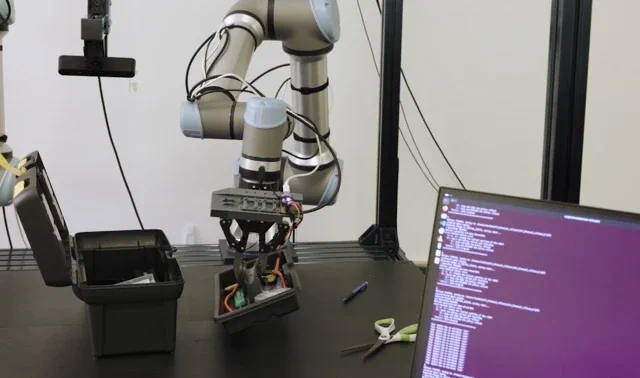

L’ingrediente segreto di Rho-alpha risiede nella sua architettura, che Microsoft definisce come un modello Vision-Language-Action Plus (VLA+). A differenza dei modelli precedenti sviluppati da competitor come Google DeepMind, che si affidano principalmente a vista e linguaggio (VLA), Rho-alpha aggiunge un senso fondamentale: il tatto. Integrando la percezione tattile, il modello può comprendere lo stato di contatto con gli oggetti e compiere manipolazioni millimetriche — come inserire un cavo o ruotare una manopola — che risultano quasi impossibili basandosi solo sulla vista.

Naturalmente, lo sviluppo di un modello simile si scontra con il più grande collo di bottiglia della robotica: la cronica scarsità di dati di qualità. Non si può fare il web scraping di trilioni di esempi di un robot che usa un cacciavite. Per superare l’ostacolo, Microsoft sta puntando tutto sulla simulazione.

“L’addestramento di foundation model capaci di ragionare e agire richiede il superamento della scarsità di dati diversificati nel mondo reale”, afferma Deepu Talla, Vice President di Robotics ed Edge AI presso NVIDIA. “Sfruttando NVIDIA Isaac Sim su Azure per generare dataset sintetici fisicamente accurati, Microsoft Research sta accelerando lo sviluppo di modelli versatili come Rho-alpha.”

Questa combinazione di dati sintetici generati in simulazione e dimostrazioni fisiche nel mondo reale è la chiave per addestrare questi modelli su larga scala. Quando il robot inevitabilmente sbaglia, un operatore umano può correggerlo tramite un mouse 3D e il sistema impara dal feedback in tempo reale.

Un sistema operativo per l’intelligenza incarnata

Se Microsoft dovesse riuscire nell’impresa, le implicazioni sarebbero enormi. Un modello robotico generalista potrebbe funzionare come un sistema operativo hardware basato sul cloud. Invece di costringere ogni azienda di robotica a costruire da zero il proprio complesso stack di IA, queste potrebbero dare in licenza un foundation model altamente capace da Microsoft, concentrandosi solo sulla costruzione di hardware migliore. Questo abbasserebbe drasticamente le barriere all’ingresso, innescando potenzialmente un’esplosione cambriana di nuove forme e applicazioni robotiche.

Questa mossa proietta Microsoft in rotta di collisione diretta con gli altri titani tecnologici. NVIDIA, con il suo Project GR00T, sta costruendo un modello di base simile, sfruttando il suo dominio nell’hardware IA e la piattaforma di simulazione Omniverse. Tesla sta seguendo un approccio verticalmente integrato con Optimus, scommettendo che la sua immensa mole di dati di guida reale le darà un vantaggio nella comprensione del mondo fisico. E Google è da anni una fucina di ricerca in questo settore.

La strategia di Microsoft sembra essere quella di una piattaforma aperta. Rendendo Rho-alpha disponibile tramite un programma di accesso anticipato e, successivamente, attraverso Microsoft Foundry, l’azienda invita i partner a costruire sopra le proprie fondamenta. Questo approccio collaborativo, supportato dalla scala immensa dell’infrastruttura cloud di Azure, rappresenta il vero asso nella manica di Redmond.

Il sogno di un robot tuttofare è ancora lontano dalla realtà. Le sfide legate alla fisica del mondo reale, alla sicurezza e ai costi sono monumentali. Ma per la prima volta, il software inizia a sembrare all’altezza della sfida. L’ambiziosa spinta di Microsoft nella “Physical AI” non è solo l’ennesimo progetto di ricerca; è il segnale inequivocabile che la corsa per costruire il cervello che animerà la prossima generazione di macchine è ufficialmente aperta. E questa volta, Microsoft fa sul serio.