L’entraînement des robots est une corvée monumentale, un cycle sans fin de réinitialisations manuelles et de surveillance constante. Pour chaque geste réussi, un humain a probablement dû remettre les objets en place des dizaines de fois après un échec. Un nouveau framework baptisé RoboClaw veut mettre fin à ce cauchemar en enseignant aux robots la compétence qui leur manquait cruellement : savoir ranger derrière eux.

Développé par des chercheurs d’AgiBot, de l’Université nationale de Singapour et de l’Université Jiao-tong de Shanghai, RoboClaw introduit un concept aussi simple qu’efficace : les Entangled Action Pairs (EAP), ou paires d’actions intriquées. L’idée centrale est que pour chaque compétence « aller » apprise par le robot — comme placer un rouge à lèvres dans son support — il apprend simultanément la compétence inverse « retour » — le retirer. Ces deux comportements créent une boucle d’auto-réinitialisation, permettant au robot de s’exercer, de remettre l’environnement en état tout seul et de recommencer, tout en collectant des données de manière autonome. Plus besoin de baby-sitter humain.

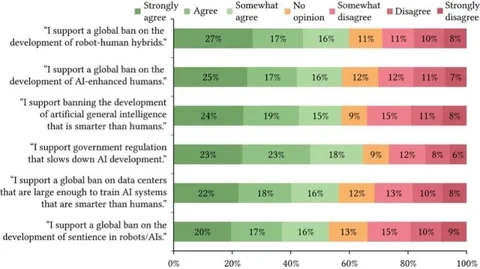

Les résultats sont, disons-le franchement, assez bluffants. Les chercheurs font état d’une réduction par 8 des interventions humaines pendant l’entraînement, d’un gain de temps humain de 2,16x par jeu de données, et d’un taux de réussite supérieur de 25 % sur des tâches complexes à plusieurs étapes par rapport aux modèles de référence. Le système a été mis à l’épreuve sur l’organisation d’une coiffeuse, où il a appris de manière autonome à manipuler et placer divers objets, tout en corrigeant ses propres erreurs en cours de route.

Pourquoi est-ce une petite révolution ?

La véritable avancée ne réside pas seulement dans cette boucle d’auto-réinitialisation. C’est le fait que le même agent qui entraîne le robot est aussi celui qui le déploie. La plupart des systèmes robotiques utilisent des pipelines totalement déconnectés pour la collecte de données, l’entraînement du modèle et l’exécution en conditions réelles. RoboClaw unifie ces trois piliers sous un contrôleur unique piloté par un Vision-Language-Model (VLM).

Concrètement, cela signifie que lorsqu’un robot échoue sur une tâche réelle, cet échec n’est plus une simple erreur qu’un humain doit corriger ; c’est une nouvelle donnée d’entraînement injectée directement dans le système. Le robot apprend de ses propres ratés sur le terrain, créant un système en boucle fermée qui s’améliore continuellement. On passe ainsi d’une automatisation rigide et préprogrammée à de véritables systèmes agentiques capables d’apprendre et de s’adapter “dans la nature”.