Nous sommes en 2035. Vous supervisez un immense atelier où s’activent 300 robots humanoïdes, exécutant leurs tâches dans un silence de cathédrale et une efficacité redoutable. Un seul détail cloche : vous vous retrouvez avec 300 télécommandes sur les bras, et votre tentative désespérée d’en faire une armure de combat géante a été, une fois de plus, retoquée par les RH. Derrière l’anecdote se cache l’un des obstacles les plus colossaux — bien que peu glamour — de notre futur automatisé : la logistique pure et simple de la gestion d’une main-d’œuvre robotique massive. Et si, au lieu de cliquer, il suffisait de… penser, pour que les machines obéissent ?

Ce scénario n’est pas le prologue d’un thriller de science-fiction, mais le problème concret que tente de résoudre Kinexus, un nouveau projet open-source ambitieux. Alors que l’industrie semble s’orienter vers des interfaces cerveau-machine (BCI) invasives à la Neuralink, Kinexus choisit une voie plus accessible. Le système utilise un casque EEG non invasif pour traduire les ondes cérébrales et les commandes vocales de l’utilisateur en actions directes pour toute une flotte de robots. Ici, pas d’implants chirurgicaux, mais la construction d’un pont pragmatique et évolutif entre l’esprit humain et l’usine de demain.

La crise de la scalabilité dans le contrôle robotique

À mesure que les usines et les centres logistiques déploient des vagues de robots humanoïdes, ils se heurtent à un mur opérationnel. Le modèle “un opérateur pour un robot” est tout simplement incapable de passer à l’échelle. Aujourd’hui, le contrôle passe souvent par des interfaces logicielles complexes ou des consoles de programmation (“teach pendants”) archaïques qui exigent une configuration individuelle laborieuse. C’est un goulot d’étranglement qui vient briser la promesse d’efficacité de la robotique. Piloter une poignée de machines est déjà complexe ; en gérer des centaines relève du cauchemar logistique.

C’est là qu’intervient la nécessité d’un centre de commandement centralisé et intuitif. L’industrie a désespérément besoin d’un “plan de contrôle” pour ses actifs physiques, un outil permettant à un unique superviseur d’orchestrer une flotte entière de manière fluide. Kinexus parie sur l’interface utilisateur la plus naturelle qui soit : celle avec laquelle nous venons tous au monde, notre cerveau.

Kinexus : Le cerveau comme nouveau tableau de bord

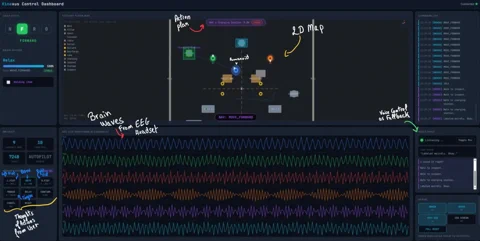

Dans les faits, Kinexus se présente comme un tableau de bord de contrôle agissant comme un interprète en temps réel entre vous et votre armée de métal. Imaginé par le développeur IA Mourad Ouazmour et codé principalement en Python, le système ambitionne de devenir le système nerveux central de l’automatisation industrielle. Il visualise les signaux cérébraux captés par un casque EEG du commerce, les traduit en commandes discrètes et cartographie l’intégralité de l’usine pour une conscience situationnelle totale.

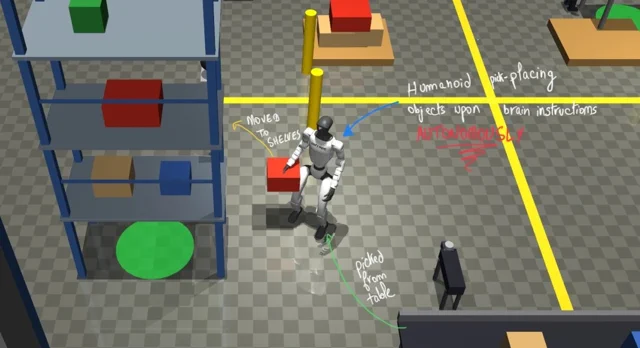

Le schéma de contrôle est d’une simplicité désarmante. Selon les explications du développeur, un utilisateur pourrait serrer le poing droit pour faire pivoter un robot vers la droite, serrer les deux poings pour avancer, ou même un simple mouvement de langue pour changer de mode. Le tableau de bord affiche cette mécanique en direct :

- Flux EEG en temps réel : Une retransmission directe de l’activité électrique de votre cerveau, décomposée en différents canaux.

- Panneau des méthodes : Le véritable moteur de traduction. C’est ici que des stimuli mentaux spécifiques (comme imaginer un mouvement de main) sont associés à des actions robotiques telles que “MOVE_LEFT” ou “MOVE_FORWARD”.

- Carte de l’usine : Un schéma 2D montrant la position de chaque humanoïde, son état de santé et sa mission en cours.

- Alternative vocale : Pour les tâches autonomes plus complexes, le système délaisse la “télépathie” directe. L’utilisateur peut simplement dire : “Récupère le carton sur le convoyeur et dépose-le sur la palette 2”, et l’unité désignée naviguera et exécutera la séquence de manière autonome.

Entre ambition SF et réalité Open-Source

Si l’idée de contrôler des machines par EEG n’est pas totalement nouvelle, son application à la gestion de flottes industrielles est ce qui rend Kinexus si fascinant. Jusqu’ici, la recherche sur les commandes EEG s’était surtout concentrée sur l’assistance aux personnes en situation de handicap ou sur le contrôle d’un robot unique, avec des taux de précision oscillant entre 70 % et plus de 90 % selon les méthodes. Kinexus veut sortir cette technologie des laboratoires pour la propulser sur le terrain.

Le choix de rendre Kinexus open-source sur GitHub est sans doute son atout majeur. Cela démocratise l’accès à ce paradigme de contrôle avancé. On ne parle pas ici d’un produit verrouillé par un géant de la tech, mais d’une boîte à outils ouverte à tous pour expérimenter, améliorer ou intégrer des plateformes comme OpenBCI. C’est une invitation lancée à la communauté des développeurs pour résoudre les défis inhérents à l’EEG, comme le bruit du signal ou la nécessité d’un étalonnage propre à chaque utilisateur.

Certes, le chemin entre un dépôt GitHub et une usine pilotée par la pensée est encore long. L’EEG non invasif offre une résolution bien moindre que les méthodes chirurgicales, et atteindre la fiabilité de 99,9 % requise par l’industrie reste un défi monumental. Mais Kinexus ne vend pas un produit fini ; il propose une vision audacieuse. Celle d’un futur où la supervision humaine dans des environnements automatisés ne sera plus une question de boutons pressés frénétiquement, mais une simple affaire d’intention stratégique. Pour l’instant, c’est un aperçu saisissant d’un monde où diriger des centaines de robots ne demandera pas plus d’effort qu’une simple pensée passagère.