Entrenar a un robot es, hoy por hoy, un calvario de proporciones bíblicas: una rutina tediosa de reinicios manuales y supervisión constante. Por cada movimiento que un robot logra dominar, hay un humano detrás que probablemente ha tenido que recomponer la escena docenas de veces tras cada fallo. RoboClaw, un nuevo framework de aprendizaje, llega para poner fin a esta pesadilla enseñando a las máquinas la única habilidad que les faltaba para ser independientes: aprender a recoger sus propios juguetes.

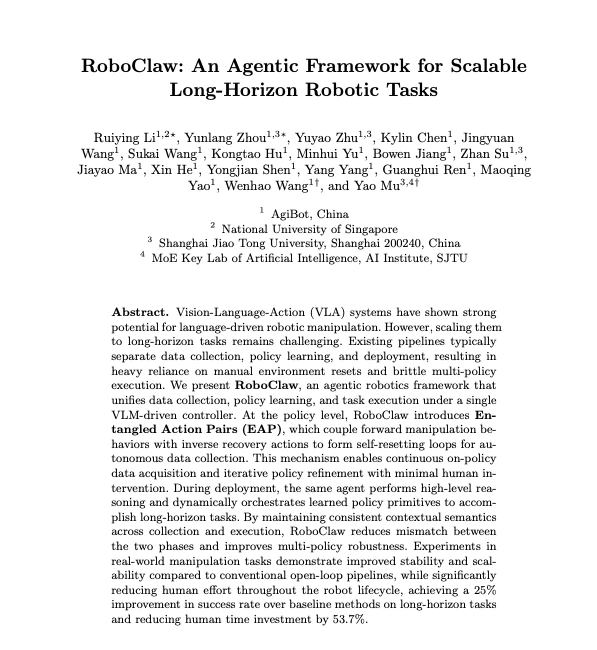

Desarrollado por investigadores de AgiBot, la Universidad Nacional de Singapur y la Universidad Jiao Tong de Shanghái, RoboClaw introduce un concepto de una sencillez casi insultante pero increíblemente efectivo: los Entangled Action Pairs (EAP) o Pares de Acción Entrelazados. La idea central es que por cada habilidad “hacia adelante” que aprende un robot —como colocar un pintalabios en su soporte—, también debe aprender la habilidad inversa o de “deshacer” —volver a sacarlo—. Estos dos comportamientos crean un bucle de auto-reinicio que permite al robot practicar una tarea, resetear el entorno por sí mismo y repetir el proceso, todo mientras recopila datos de forma autónoma. Se acabó lo de tener a una niñera humana vigilando cada paso.

Los resultados son, sinceramente, una locura. Los investigadores informan de una reducción de 8 veces en la intervención humana durante el entrenamiento, una mejora de 2,16 veces en la eficiencia del tiempo humano necesario por cada conjunto de datos y una tasa de éxito un 25% mayor en tareas complejas de varios pasos en comparación con los modelos de referencia. El sistema se puso a prueba en una tarea de organización de un tocador, donde el robot aprendió de forma autónoma a manipular y colocar diversos objetos, recuperándose de sus propios errores sobre la marcha.

¿Por qué es esto realmente importante?

El verdadero hito no es solo el bucle de auto-reinicio. Es que el mismo agente que entrena al robot es el que lo despliega. La mayoría de los sistemas robóticos actuales utilizan flujos de trabajo totalmente inconexos para la recopilación de datos, el entrenamiento del modelo y la ejecución en el mundo real. RoboClaw unifica los tres pilares bajo un único controlador impulsado por Modelos de Lenguaje y Visión (VLM).

Esto significa que cuando el robot falla en una tarea real, ese error no es simplemente un fallo que un humano debe corregir; es una nueva unidad de entrenamiento que se retroalimenta directamente al sistema. El robot aprende de sus propias pifias sobre el terreno, creando un sistema de circuito cerrado que mejora continuamente. Estamos ante el paso definitivo para que la robótica deje de ser una automatización rígida y preprogramada para convertirse en sistemas agénticos capaces de aprender y adaptarse “en estado salvaje”.