Justo cuando pensabas que el circo del hype de la inteligencia artificial no podía volverse más surrealista, una empresa australiana ha decidido mandar las GPU a paseo para conectar una IA directamente a un cerebro vivo. Bueno, más o menos. Cortical Labs, la firma de biotecnología que ya nos dejó boquiabiertos enseñando a una placa con 800.000 neuronas humanas a jugar al clásico Pong, ha decidido subir la apuesta. Tras entrenar con éxito a un nuevo “ejército” de 200.000 neuronas para navegar por los pasillos infestados de demonios de DOOM, ahora han cableado su “DishBrain” a un Modelo de Lenguaje de Gran Escala (LLM).

Sí, lo has leído bien. Neuronas humanas reales, disparando impulsos eléctricos sobre un chip de silicio, son las que ahora eligen las palabras que dicta una IA. No estamos ante otro pasito incremental en el machine learning; es un salto bizarro, fascinante y, para qué engañarnos, algo inquietante hacia el mundo del wetware y la computación biológica. Francamente, hace que tu chatbot promedio parezca tan avanzado como una calculadora de bolsillo.

De raquetas pixeladas a paisajes infernales

Para entender cómo hemos llegado al punto en que unas neuronas son coautoras de textos, hay que repasar los grandes éxitos de Cortical Labs. En 2022, el equipo de Melbourne saltó a la fama mundial con su experimento “DishBrain”. Cultivaron neuronas en una matriz de microelectrodos capaz de estimular las células y leer su actividad simultáneamente. Al enviar señales eléctricas que indicaban la posición de la bola en el Pong, las neuronas aprendieron a disparar de forma que controlaban la pala, demostrando un aprendizaje orientado a objetivos en apenas cinco minutos. Fue una prueba de concepto brutal de lo que llaman inteligencia biológica sintética.

Pero el Pong es juego de niños. En el mundo del hardware existe un mantra sagrado para juzgar cualquier tecnología: “¿Puede correr DOOM?”. Así que, naturalmente, eso fue lo siguiente que hizo Cortical Labs. El salto del mundo plano y sencillo de Pong al entorno 3D de DOOM es abismal; requiere navegación espacial, detección de amenazas y toma de decisiones en tiempo real. Y aun así, las neuronas aprendieron. El feed de vídeo del juego se tradujo en patrones de estimulación eléctrica, y las respuestas de las neuronas se decodificaron en acciones dentro del juego, como moverse o disparar. Aunque su rendimiento se parecía más al de un principiante patoso que al de un pro-player, demostró que el sistema podía gestionar tareas dinámicas extremadamente complejas.

Un “fantasma biológico” en la máquina del LLM

Tras conquistar los videojuegos clásicos, el siguiente paso lógico era, al parecer, darles voz a las neuronas. El último experimento, desvelado por figuras como el evangelista tecnológico Robert Scoble, muestra a las células cerebrales interactuando con un LLM. En lugar de mover una raqueta o a un marine espacial, los impulsos eléctricos de las neuronas se utilizan ahora para seleccionar cada token —ya sea una letra o una palabra— que genera la IA.

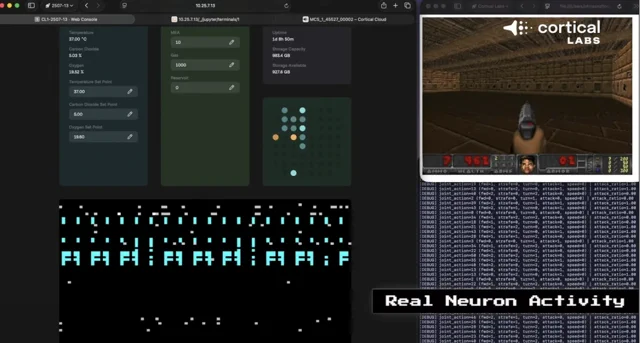

Un vídeo filtrado muestra el proceso en acción: una rejilla muestra los canales estimulados y el feedback correspondiente de las neuronas mientras “deciden” colectivamente la siguiente pieza del texto. Es una mirada cruda y sin filtros a la materia biológica realizando una tarea cognitiva que, hasta ahora, era dominio exclusivo de algoritmos complejos ejecutándose en silicio sediento de energía.

“Hemos demostrado que podemos interactuar con neuronas biológicas vivas de tal manera que las obligamos a modificar su actividad, dando lugar a algo que se asemeja a la inteligencia”, afirmó el Dr. Brett Kagan, Director Científico de Cortical Labs, sobre sus trabajos anteriores.

Este nuevo avance lleva esa interacción a una dimensión desconocida. Una cosa es reaccionar a una bola que rebota; otra muy distinta es participar activamente en la construcción del lenguaje.

¿Para qué molestarse con cerebros?

Llegados a este punto, te preguntarás: ¿por qué pasar por el engorro de mantener vivas 200.000 neuronas en una placa cuando una GPU de gama alta puede ejecutar un LLM sin quejarse? La respuesta está en la eficiencia y en los límites físicos del silicio. El cerebro humano realiza cálculos asombrosos consumiendo unos 20 vatios de potencia, el equivalente a una bombilla tenue. Un superordenador que intente simular esa misma actividad requiere millones de veces más energía.

Cortical Labs y otros pioneros del sector apuestan a que esta increíble eficiencia energética puede ser domesticada. Los sistemas biológicos son maestros del procesamiento en paralelo y del aprendizaje adaptativo de formas que los ordenadores tradicionales, deterministas y binarios, sudan para replicar. Al fusionar neuronas vivas con silicio, están creando una arquitectura de computación híbrida que algún día podría alimentar sistemas que aprendan más rápido y consuman una fracción de la energía actual.

Esto no va solo de construir un chatbot mejor. El equipo de Cortical Labs, liderado por su CEO, el Dr. Hon Weng Chong, vislumbra un futuro donde esta tecnología revolucione la robótica, la medicina personalizada y el descubrimiento de fármacos. Imagina un robot que no solo ejecute comandos preprogramados, sino que aprenda y se adapte a un entorno nuevo con la inteligencia fluida de un sistema biológico. O considera el uso de las propias neuronas de un paciente en un chip para probar la eficacia de diferentes fármacos contra enfermedades neurológicas como la epilepsia.

El camino por delante es largo y tortuoso. Los sistemas biológicos son complejos y pueden ser impredecibles, lejos de la consistencia infalible del silicio. Pero como ha demostrado Cortical Labs, un puñado de células en una placa ya ha pasado de jugar a videojuegos a hablar. La posibilidad de que esas mismas neuronas controlen algún día un robot ya no es ciencia ficción: es el siguiente punto en su hoja de ruta. Y esa es una idea que resulta, simultáneamente, aterradora y excitante.