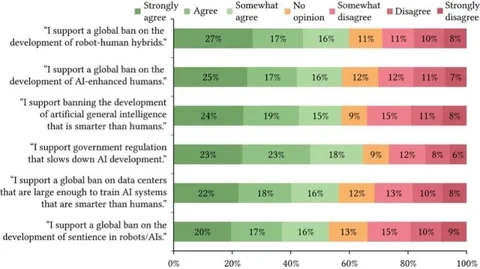

La industria de la robótica guarda un secreto a voces: enseñar a los robots a hacer algo útil es un proceso desesperantemente lento y de un coste estratosférico. Durante años, el dogma establecido ha sido imponer la inteligencia a base de fuerza bruta con modelos de Visión-Lenguaje-Acción (VLA), que exigen decenas de miles de horas de humanos manejando robots meticulosamente, como marionetas, a través de cada tarea imaginable. Es, ni más ni menos, un cuello de botella de datos de proporciones épicas.

Ahora, la firma de robótica 1X propone una solución que raya la herejía. Su nuevo enfoque para el humanoide NEO es engañosamente sencillo: basta de lecciones extenuantes; simplemente deja que el robot aprenda observando la inmensa, caótica e infinitamente instructiva biblioteca de comportamiento humano que llamamos internet. Esto no es solo una mejora; es un giro copernicano en cómo un robot puede adquirir habilidades.

La bestia insaciable de datos de ayer

Para dimensionar el salto que está dando 1X, hay que entender el statu quo. La mayoría de los modelos fundacionales modernos para robótica, desde Helix de Figure hasta GR00T de Nvidia, son VLAs. Estos modelos son potentes, sí, pero tienen un apetito voraz por datos de demostración de alta calidad y específicos para robots. Esto se traduce en pagar a personas para teleoperar robots durante miles de horas, recolectando ejemplos de, por ejemplo, cómo coger una taza o doblar una toalla.

Este enfoque es un obstáculo considerable para la creación de robots verdaderamente de propósito general. Es caro, no escala bien y los modelos resultantes pueden ser frágiles, fallando cuando se enfrentan a un objeto o un entorno que no han visto antes. Es como intentar enseñar a un niño a cocinar solo dejándole verte en tu propia cocina, en lugar de permitirle hacer un atracón de todos los programas de cocina habidos y por haber.

Soñar, soñar… con hacer las tareas de casa

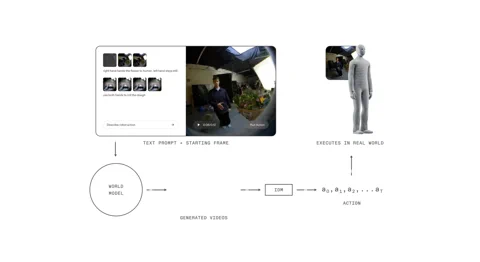

El 1X World Model (1XWM) tira ese manual por la ventana. En lugar de mapear directamente el lenguaje a las acciones, utiliza la generación de vídeo condicionada por texto para averiguar qué hacer. Es un cerebro bicéfalo que permite al robot, de manera efectiva, imaginar el futuro antes de actuar.

Primero, está el World Model (WM), un modelo generativo de vídeo de 14 mil millones de parámetros que actúa como la imaginación del sistema. Le das a NEO una instrucción de texto —“mete esta naranja en la fiambrera”— y el WM, observando la escena actual, concibe un vídeo corto y verosímil de la tarea completada.

Luego, el Inverse Dynamics Model (IDM), el pragmático de la máquina, analiza ese sueño. Traduce los píxeles generados en una secuencia concreta de comandos motores, tendiendo un puente entre un qué visual y un cómo físico. Este proceso se asienta en una estrategia de entrenamiento multifase: el modelo comienza con vídeo a escala web, se preentrena con 900 horas de vídeo humano egocéntrico para obtener una perspectiva en primera persona, y finalmente se ajusta con tan solo 70 horas de datos específicos de NEO para adaptarse a su propio cuerpo.

Un truco ingenioso en su pipeline de entrenamiento es el “caption upsampling” (muestreo ascendente de subtítulos). Dado que muchos conjuntos de datos de vídeo tienen descripciones escuetas, 1X utiliza un VLM para generar pies de foto más ricos y detallados. Esto proporciona un condicionamiento más claro y mejora la capacidad del modelo para seguir instrucciones complejas, una técnica que ha mostrado beneficios similares en modelos de imagen como DALL-E 3 de OpenAI.

La ventaja humanoide

Todo este enfoque que prioriza el vídeo se sustenta en una pieza de hardware crítica, y quizás obvia: el robot tiene forma de persona. El 1XWM, entrenado con incontables horas de humanos interactuando con el mundo, ha desarrollado una comprensión profunda e implícita de los priors físicos —gravedad, momento, fricción, affordances de los objetos— que se transfieren directamente porque el cuerpo de NEO se mueve de una manera fundamentalmente humana.

Como bien lo expresa 1X, el hardware es “un ciudadano de primera clase en la pila de IA”. Las similitudes cinemáticas y dinámicas entre NEO y un humano significan que los priors aprendidos del modelo generalmente siguen siendo válidos. Lo que el modelo puede visualizar, NEO puede, en la mayoría de los casos, hacerlo. Esta estrecha integración de hardware y software cierra el abismo, a menudo traicionero, entre la simulación y la realidad.

De la teoría a la realidad (con algún traspié)

Los resultados son convincentes. El 1XWM permite a NEO generalizar a tareas y objetos para los que no tiene ningún dato de entrenamiento directo. El vídeo promocional lo muestra planchando una camisa, regando una planta e incluso accionando un asiento de inodoro, una tarea para la que no tenía ejemplos previos. Esto sugiere que el conocimiento para la coordinación bimanual y la interacción compleja con objetos se está transfiriendo con éxito a partir de los datos de vídeo humanos.

Pero esto no es magia. El sistema tiene sus limitaciones. Las simulaciones generadas pueden ser “demasiado optimistas” sobre el éxito, y su preentrenamiento monocular puede conducir a un grounding 3D débil, lo que provoca que el robot real se quede corto o se pase del objetivo incluso cuando el vídeo generado parece perfecto. Las tasas de éxito en tareas de destreza como verter cereales o dibujar una cara sonriente siguen siendo un desafío.

Sin embargo, 1X ha encontrado una vía prometedora para potenciar el rendimiento: el test-time compute. Para una tarea de “sacar un pañuelo”, la tasa de éxito saltó del 30% con una única generación de vídeo al 45% cuando al sistema se le permitió generar ocho futuros posibles diferentes y seleccionar el mejor. Si bien esta selección es actualmente manual, apunta a un futuro donde un evaluador VLM podría automatizar el proceso, mejorando significativamente la fiabilidad.

El volante de inercia del autoaprendizaje

El 1XWM representa mucho más que una actualización incremental; es un potencial cambio de paradigma que podría abrir de par en par el cuello de botella de los datos. Crea un volante de inercia para la auto-mejora. Al ser capaz de intentar un amplio abanico de tareas con una tasa de éxito no nula, NEO puede ahora generar sus propios datos. Cada acción, sea un éxito o un fracaso, se convierte en un nuevo ejemplo de entrenamiento que puede ser reintroducido en el modelo para refinar su política. El robot empieza a enseñarse a sí mismo.

Por supuesto, persisten obstáculos importantes. El WM tarda actualmente 11 segundos en generar un plan de 5 segundos, con otro segundo para que el IDM extraiga las acciones. Esa latencia es una eternidad en un entorno dinámico y real, y un punto de partida inviable para tareas reactivas o manipulación delicada y con contacto.

Aun así, al abordar el problema de los datos de frente, 1X puede haber descerrajado la puerta a un futuro donde los robots aprenden no de nuestras tediosas instrucciones, sino de nuestra experiencia colectiva y registrada. Ese futuro se está acelerando, un vídeo de internet a la vez.