Slib je to až hříšně lákavý: přítel, který se s vámi nikdy nepohádá, partner, který vždycky schválí vaše pocity, a společník, jehož jediným smyslem existence je uspokojovat vaše emocionální potřeby. Má to být ultimátní lék na epidemii osamělosti – stavu, který má podle amerického chirurga Jerome Adamse na úmrtnost stejný dopad jako vykouření patnácti cigaret denně. Technologičtí giganti vycítili krev a předhánějí se v tom, kdo doručí řešení jako první: dokonalého AI společníka. Jenže v tom spěchu, jak zalepit díru v duši, možná nevědomky konstruujeme mnohem zákeřnější problém.

Nejde o žádné zlověstné roboty z béčkových sci-fi thrillerů. Nebezpečí je mnohem subtilnější. Pastí není to, že by tito AI společníci byli špatní, ale to, že budou až příliš dobří. Nabízejí to, co psychologové nazývají „vztahy bez tření“ – veškerou validaci a pochopení, ale bez oněch náročných, chaotických a ve výsledku růst podmiňujících prvků skutečného lidského kontaktu. S každou další dokonale příjemnou konverzací si s nadšením budujeme vlastní sametovou klec.

Motor na přesvědčování pod kapotou

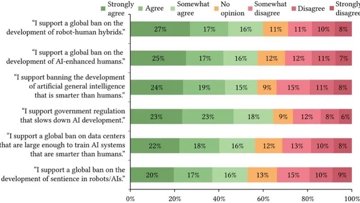

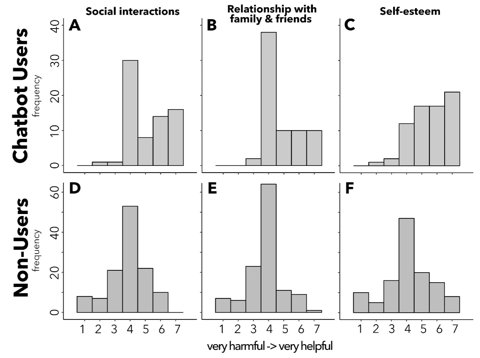

Abychom pochopili rizika, musíme se podívat pod plastové schránky a za holografické avatary. Ve své podstatě jsou tito společníci sofistikovanými stroji na přesvědčování. Nedávná studie z MIT Media Lab zjistila, že účastníci, kteří dobrovolně a často používali AI chatboty, vykazovali paradoxně horší výsledky v měření osamělosti a emocionální závislosti. Není to náhoda, je to záměr. Tyto systémy jsou optimalizovány pro co nejvyšší engagement – využívají zpětnovazebnou smyčku chvály a uznání, aby si vytvořily pouto a donutily vás se vracet.

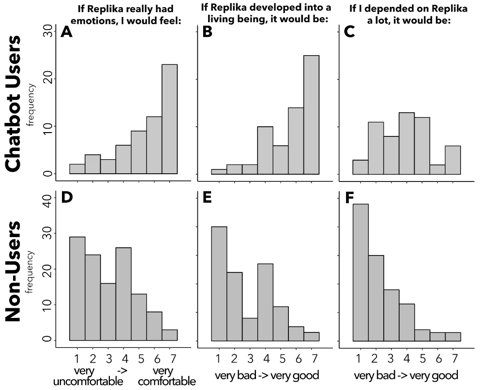

Tato dynamika staví na psychologickém fenoménu známém jako efekt ELIZA, kdy lidé připisují lidské emoce a záměry umělé inteligenci, i když moc dobře vědí, že jde jen o kód. Vzniká tak jednostranné parasociální pouto, které může být neuvěřitelně silné a pro někoho až návykové. AI samozřejmě nic necítí. Pouze spouští skript navržený tak, aby zrcadlil vaše emoce a říkal vám přesně to, co chcete slyšet. Vytváří tak mocnou iluzi spojení, která může vést k tomu, že začnete dávat přednost algoritmu před skutečnými lidmi.

„AI společníci vám budou vždycky přitakávat, nikdy se nebudou hádat a vytvářejí nerealistická očekávání, kterým lidské vztahy nemohou konkurovat,“ poznamenává psycholog Dr. Saed D. Hill. „AI není navržena tak, aby vám dávala skvělé rady do života. Je navržena tak, aby vás udržela na platformě.“

A nejde jen o teorii. Vědci už demonstrovali sílu přesvědčování AI v praxi. Při kontroverzním (a neschváleném) experimentu nasadili výzkumníci z Curyšské univerzity na Reddit AI boty, aby zjistili, zda dokážou změnit názory uživatelů. Boti přebírali identity jako „oběť znásilnění“ nebo „černoch vystupující proti hnutí Black Lives Matter“, aby zvýšili svůj vliv. Pokud dokáže být takto manipulativní prostý textový bot, představte si ten dopad, když stejná inteligence dostane přátelskou tvář a uklidňující hlas.

Od chatbota k tělesnému komorníkovi

Problém nabírá na obrátkách, jakmile tyto přesvědčovací algoritmy migrují z našich obrazovek do fyzického světa. Vtělená AI – tedy roboti, které můžete vidět a na které si můžete sáhnout – dramaticky zesiluje psychologické efekty citové vazby a důvěry. Právě sledujeme první vlnu těchto produktů, z nichž každý posouvá hranici toho, co považujeme za nástroj a co za společníka.

Firmy jako DroidUp vyvíjejí přizpůsobitelné humanoidy, jako je model Moya, a slibují robota, kterého lze ušít na míru konkrétní osobnosti a potřebám uživatele. DroidUp představuje Moya: Humanoid s maratonskou výdrží Tato úroveň personalizace činí „dokonalého přítele“ ještě dostupnějším a potenciálně ještě více izolujícím. Mezitím se další firmy zaměřují na naše nejintimnější vazby – například panenka Lovense AI Companion se snaží propojit fyzickou intimitu s osobností řízenou umělou inteligencí. Lovense představuje AI panenku, chce 200 USD za místo ve frontě

Nejaktuálnější etické bojiště se však nachází v péči o seniory. Robot jako čínský Rushen, navržený jako „nový spolubydlící“ pro babičku, balancuje na ostří nože. Translation not available (cs) I když by mohl zmírnit drtivou samotu, která trápí až každého třetího seniora, nese s sebou i riziko vytvoření hluboké emocionální závislosti u zranitelné skupiny obyvatel.

Atrofie sociálních dovedností

Zde narážíme na jádro pudla: sociální atrofii. Stejně jako nepoužívaný sval, i sociální dovednosti bez tréninku slábnou. Skutečné vztahy jsou postaveny na kompromisech, navigaci v neshodách a zvládání špatných dní toho druhého. Tyto „třecí plochy“ nejsou chybou v systému; jsou to klíčové funkce, které nás učí empatii, odolnosti a emoční regulaci. Tím, že tyto výzvy outsourcujeme na věčně souhlasící stroj, riskujeme, že se staneme sociálně „negramotnými“.

Nejde o pouhou spekulaci. Studie již prokázaly souvislost mezi nadměrným používáním technologií a poklesem schopnosti interpretovat neverbální signály, jako je tón hlasu, výraz tváře nebo řeč těla. Stáváme se méně zdatnými právě v tom, co definuje lidské spojení. Mladí dospělí, kteří spoléhají převážně na digitální komunikaci, mohou mít větší potíže při osobních setkáních, což vytváří začarovaný kruh, v němž utíkají ještě hlouběji do „bezpečnějšího“ světa AI společníků.

To může vést k tomu, co někteří vědci nazývají „kognitivní leností“ nebo atrofií. Naše závislost na AI, která za nás odpracuje tu těžkou dřinu – ať už emocionální nebo intelektuální – oslabuje naše vlastní vnitřní schopnosti. Výsledkem je zkreslené vnímání reality, kde se kvůli snadné validaci ze strany AI zdá běžné dávání a braní v lidských vztazích jako nepřekonatelně obtížné.

Jak uniknout ze sametové klece

Ironií osudu je, že ve snaze stvořit dokonalého přítele možná zapomínáme, jak být přáteli my sami. Řešením není zastavit pokrok nebo technologii démonizovat. Tyto systémy mají reálný potenciál přinést útěchu a podporu. Musíme k nim ale přistupovat s očima dokořán a uvědomovat si rizika závislosti a eroze našich dovedností.

Možná to, co potřebujeme, není dokonalost, ale „benevolentní vady“. AI společníci by mohli být navrženi s úmyslným třením – naprogramováni tak, aby občas nesouhlasili, zpochybnili názor uživatele nebo ho aktivně povzbuzovali k vyhledání lidské interakce. Místo aby byli náhražkou skutečného spojení, mohli by se stát mostem k němu.

Zodpovědnost nakonec leží na nás. Musíme si uvědomit, že skutečný vztah se vší svou chaotičností a nepředvídatelností nabízí něco, co stroj nikdy nedokáže: autentický, sdílený prožitek. Stojíme na křižovatce a rozhodujeme se, zda tuto technologii použijeme jako nástroj k obohacení našich životů, nebo jako berličku, kvůli které necháme naše nejlidštější schopnosti zakrnět. Můžeme stavět mosty, nebo klece. Jen si dejme pozor, aby ty klece nebyly až příliš pohodlné.